定量研究方法论多变量回归.docx

定量研究方法论多变量回归.docx

- 文档编号:5469497

- 上传时间:2022-12-16

- 格式:DOCX

- 页数:18

- 大小:248.02KB

定量研究方法论多变量回归.docx

《定量研究方法论多变量回归.docx》由会员分享,可在线阅读,更多相关《定量研究方法论多变量回归.docx(18页珍藏版)》请在冰豆网上搜索。

定量研究方法论多变量回归

第七章多变量回归

引言

在单变量回归分析中,我们已经提到应该如何去看待残差。

残差并不一定是白噪音。

残差只是因为研究者对其中的信息不加细究,而简单地把这些信息归类到残差而已。

如果现在研究者对残差中的信息感兴趣了,他就会增加自变量的个数。

相应地,残差中的信息会减少。

因为有了新的自变量来解释应变量,我们对应变量的理解也就加深了。

多变量线性回归在单变量线性回归的基础上引入更多的自变量。

因为多变量线性回归秉承了单变量线性回归的拟合方法与假设检验的思想,我们在本章将只作简单介绍。

我们要重点介绍的是多变量线性回归所特有的一些方面,包括自变量之间的关系、自变量的选择等等。

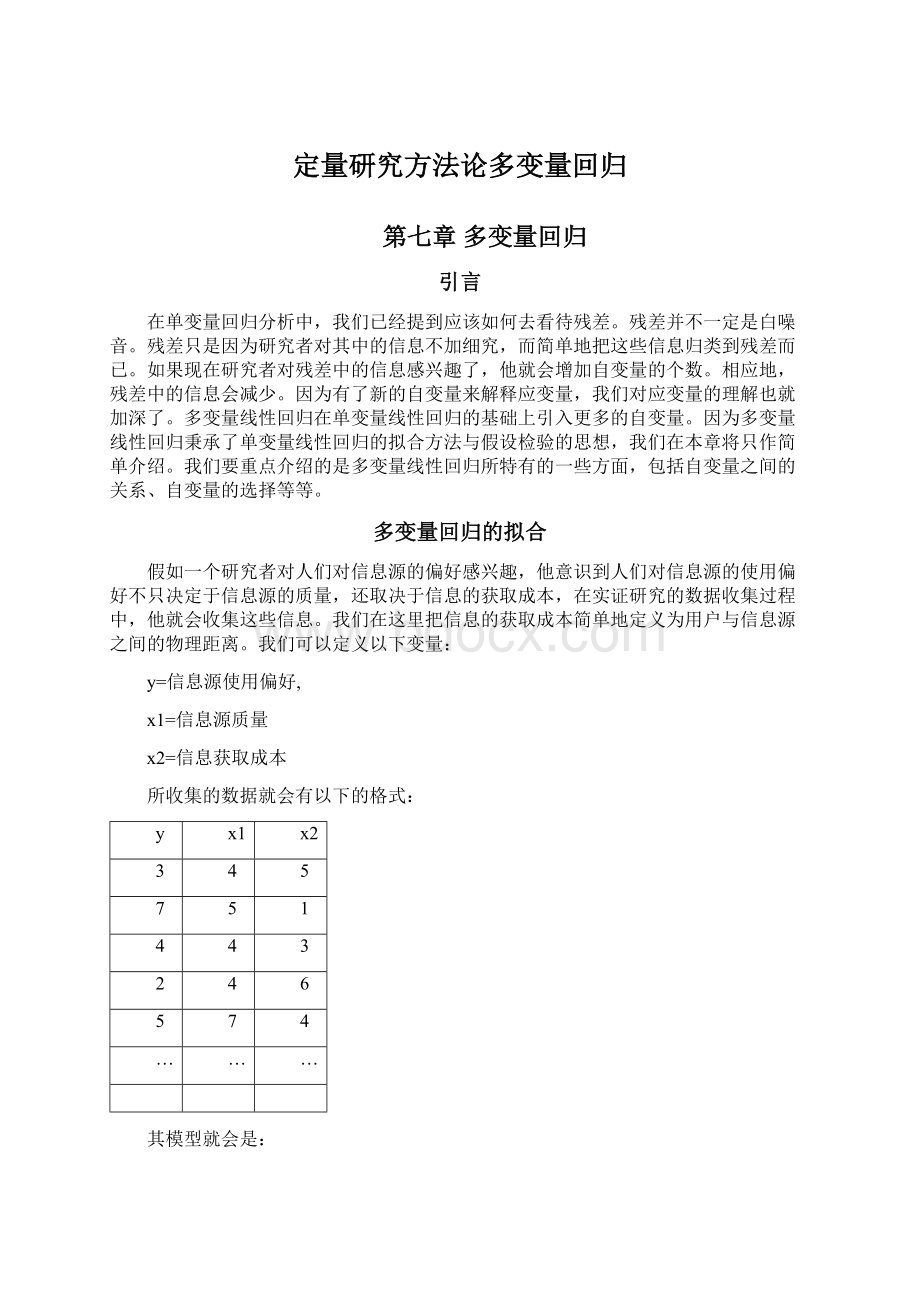

多变量回归的拟合

假如一个研究者对人们对信息源的偏好感兴趣,他意识到人们对信息源的使用偏好不只决定于信息源的质量,还取决于信息的获取成本,在实证研究的数据收集过程中,他就会收集这些信息。

我们在这里把信息的获取成本简单地定义为用户与信息源之间的物理距离。

我们可以定义以下变量:

y=信息源使用偏好,

x1=信息源质量

x2=信息获取成本

所收集的数据就会有以下的格式:

y

x1

x2

3

4

5

7

5

1

4

4

3

2

4

6

5

7

4

…

…

…

其模型就会是:

。

这种关系反映在空间分布上,表现为y分布在由x1、x2组成的平面的两侧。

在0的地方使用常量向量1,把以上5个样本点写成矩阵模型是:

以上模型可以缩略成矩阵形式:

对于一个样本,忽略项,通过简单的矩阵运算可以得到:

其中:

这样自变量的回归系数b就可以得到了。

问题是,这样得到的自变量回归系数可靠吗?

它有没有把残差极小化,就象在最小二乘法中那样?

答案是肯定的。

我们将不对此进行证明。

感兴趣的读者可参看本章的附录。

在这里,我们要强调的是对这个结论的理解。

在这个解中,矩阵X’X对角线上的元素表示的是各x变量未经均值修正(uncorrected)的方差和,非对角线上的元素则是x变量之间的积和(cross-product)。

所以,这个矩阵又叫方差和与积和矩阵(SSCP-sumofsquaresandcross-productsmatrix)。

直观地,如果我们把矩阵(X’X)的逆看作倒数,把X’y看作积和,b是X与y的积和除以X的方差和与积和,这和我们在单变量回归中所得到的结果(b1=SSxy/SSxx)是一致的。

我们可以把X’X的逆记为:

。

与单变量的情形类似,可以证明(略)每个自变量的回归系数:

。

当我们不知道

时,我们代入它的样本估计量MSE:

。

如果我们一样假定应变量服从单一的、独立的、均值为零的正态分布,我们就可以推得bi/s(bi)服从t分布,从而检验关于bi的假设。

与单变量的线性回归一样,我们可以对应变量进行方差分析。

y中的总方差是:

其中被自变量解释的部分是:

,

剩余部分是:

。

SSyy=SSR+SSE。

这和单变量的情形没有什么不同。

其ANNOVA是:

SourceofVariation

SS

df

MeanSquares

Regression

p

MSR=SSR/p

Error

n-p-1

MSE=SSE/(n-p-1)

Total

n-1

MST=SST/(n-1)

Correctionformean

1

Total,uncorrected

n

其中p是参数(所要求的回归系数)个数。

相应地,我们可以计算多变量情况下的决定系数R2:

我们也可以构造一个关于SSR/SSE的F统计量。

这样我们就可以测试拟合度的总体显著性。

H0:

1=…p=0

Ha:

atleastoneparameterisnonzero

可以证明:

。

所以对F测试也是对R2的测试。

至此,我们可以用多变量线性回归来做

(1)假设检验和

(2)拟合度检验。

前者往往用于对一个理论假设的测试,而后者则是对一组自变量总体的有效性的测试,它反映了所解释的与未解释的信息的比例。

我们一样地作了如下的假定:

应变量服从单一的、独立的、均值为零的正态分布。

那么如何来理解一个拟合的多变量线性回归的回归系数呢?

对于一个拟合的模型:

,

b0是当x1与x2皆为零时的应变量取值。

而bi则应当理解为当xi变化一个单位,假定其它的自变量不变,应变量会变化bi个单位。

这里的重点是要假定其它的自变量不变。

在现实情况中,因为自变量之间几乎总是相关的,所以这种理解几乎总是不成立的。

这提醒我们一个系统在变化的时候几乎很少是只在一个方向上变化,而是同时在多个方向上变化。

这同时也告诉我们,如果模型中意义相近的自变量越多,它们的回归系数就越无法解释、越没有解释作用。

一个好的模型应该包括相对独立的自变量,每个对应变量都有各自独特的贡献。

在极少的情况下,如果建模的目的不是为了解释,而是为了预测,就不需受此约束。

每一个自变量的作用

如果简单地从对每一个自变量的t-test来看,我们似乎可以由此断定一个自变量是否对应变量有贡献、即是否显著地影响着应变量。

但事实并非如此简单。

我们先来看一个例子。

在这个例子中,研究者假设消费者对网店的信任受到网店的设计的影响。

设计因素包括两方面,一是这个网店的易用性(easeofuse),二是网店的使用是否很容易学得会,即易学性(easeoflearning)。

106个消费者对几个不同的网店进行了易用性(x1)、易学性(x2)、与信任度(y)的打分(LikertScale,1-7分)。

我们对这些变量建立三个模型:

(1)y=f(x1),

(2)y=f(x2),(3)y=f(x1,x2)。

我们在下面报告它们的拟合的回归模型和方差分析。

y=3.50+0.39x1+e,R2=0.17

Model

SumofSquares

df

MeanSquare

F

Sig.

1

Regression

15.23

1

15.23

21.01

0.00

Residual

75.35

104

0.72

Total

90.58

105

y=4.18+0.26x1+e,R2=0.10

Model

SumofSquares

df

MeanSquare

F

Sig.

2

Regression

9.08

1

9.08

11.58

0.00

Residual

81.50

104

0.78

Total

90.58

105

y=3.49+0.69x1-0.29x2+e,R2=0.19,x2isinsignificantwitht=0.12.

Model

SumofSquares

df

MeanSquare

F

Sig.

3

Regression

17.00

2

8.50

11.90

0.00

Residual

73.58

103

0.71

Total

90.58

105

x2=1.00+0.80x1+3,R2=0.83

Model

SumofSquares

df

MeanSquare

F

Sig.

1

Regression

83.19

1

83.19

514.65

0.00

Residual

16.81

104

0.16

Total

100.00

105

a

Predictors:

(Constant),peol

b

DependentVariable:

peou

以下的数据显示x1和x2在模型一和模型二中对y的贡献是显著的。

而当我们把它们放在一起的时候,x2变得不显著,而且,其回归系数是负的。

如果我们只看模型三并得出x2对y不重要的结论,这个结论显然是不符常理的。

可是为什么为这样呢?

难道相关的自变量不是越多越好吗?

让我们对这些变量进行抽丝剥茧地检查。

首先,如果我们看这三个变量之间的相关性,显然其相关性都是极显著的,而且是相关的。

这说明不管是PEOU还是PEOL都对TRUST产生显著影响。

这和模型一、二的结论是一致的。

如果我们把这个相关系数进行平方,我们可以得到相应的R2,且与回归分析模型一、二所得的R2是吻合的。

PEOU

PEOL

TRUST

PEOU

1

PEOL

0.91**

1

TRUST

0.41**

0.32**

1

**Significantatp<0.001level.

现在我们比较模型一和模型三。

当引入x2后,回归模型所能解释的信息显然是增加了,SSR(x2|x1)=SSR(x1,x2)-SSR(x1)=17.00-15.23=1.77,我们把这种增加的SSR(x2|x1)叫作额外平方和。

可是增加的幅度却很小。

比较模型二中的数据,x2独自时能解释9.08,却在一个组合的模型中只能增加1.77。

一样地,我们可以计算x1的SSR(x1|x2)=SSR(x1,x2)-SSR(x2)=17.00-9.08=7.92,这只有它在模型一中的一半。

要注意,额外平方和与残差的变化是对应的,比如SSR(x2|x1)=SSE(x1)-SSR(x1,x2)=1.77。

可是为什么一个变量在一个组合的模型中的贡献会变小呢?

这种现象是多变量回归与单变量回归一个很大的不同,也是理解多变量回归的关键。

原因其实很简单:

这两个自变量之间有太多的信息重复。

这反映在它们之间的相关系数上(0.91)。

这种现象其实可以从回归模型中直接推得,因为:

也即,所解释的应变量中的信息是由一部分的x1信息,一部分的x2信息,与x1、x2的共同信息(协方差)决定的。

所以当共同信息很大时,如果R2是一定的,回归系数会变小,表明一个变量的独特贡献变小。

相应地,如果我们把这种分解反映在方差分析上(以x1为第一个自变量),我们有:

Model

SumofSquares

df

MeanSquare

F

Sig.

3

Regression

17.00

2

8.50

11.90

0.00

x1

15.23

1

15.23

21.32

0.00

x2|x1

1.77

1

1.77

2.48

0.12

Residual

73.58

103

0.71

Total

90.58

105

对方差分析进行这样的进一步分解的一个好处是我们可以检验每个自变量的贡献。

如同单变量线性回归,我们可以建立一个关于每个自变量的F统计量:

这个统计量是不显著的,表示x2没有额外的贡献。

这与组合模型三的t检验结果是一致的。

与单变量的情形一样,我们可以证明这个F检验与t检验是等价的,所以F-test给了我们另外一种假设检验的方法。

在实际科研中,用F检验并不常见,因为t检验已经可以满足需要。

但是F检验有其特有的应用,尤其是在追求模型的简洁性时。

它允许我们同时对多个自变量的联合显著性进行测试。

比如,我们可测试是不是x3,x4,x5在x1,x2的基础之上有额外的贡献。

比如对于两个模型:

我们可能想知道增加x3,x4,x5是否“值得”。

这时我们把第一个模型叫作简化模型(reducedmodel),第二个完整模型(completeorfullmodel)。

简化模型被完整模型包含(nested)。

我们的假设是:

H0:

3=4=5=0

H1:

至少有一个不是0。

由以上的额外平方和,类似单变量时的作法,我们可以定义一个偏决定系数(partialdeterminant)来表示一个自变量的额外平方和对应变量中的剩余信息(被x1解释后的残差中的信息)的贡献。

比如,如果x1已经在模型中,那么x2的贡献是:

。

要注意,如果x1已经在模型中,应变量中的剩余信息的SSE(x1),而不是SSyy。

对偏决定系数求平方根,我们可以得到偏相关系数。

至此,我们从额外平方和的角度解释了一个自变量在模型中的作用。

下面我们来看回归系数是否也反映了这种自变量的独特信息。

我们以一个双自变量的模型为例:

我们对所有的自变量和应变量进行标准化,使其方差为1、均值为零,以简化计算。

我们先来看x1中相对于x2的独特信息。

显然,这部分信息是x1被x2解释的后的剩余信息,即如果我们以x1为应变量、以x2为自变量所得的残差中的信息。

这部分信息为(

)。

那么这些残差的数值又是多少呢?

是

,因为对于标准化的变量,回归系数就是相关系数。

我们再来看组合模型的解。

已经量x2)orfullmodel)_________________________________________________________________________________________________________因为:

根据

,可得:

=(x1的相对于x2的残差与y的积和/x1中的独特信息)

=(x2的相对于x1的残差与y的积和/x2中的独特信息)

至此,我们可以看到b1的分子反映的是x1相对于x2的独特信息与y的积和,而不是x1中所有的信息与y的积和(分母是x1相对于x2的独特信息)。

当然,当自变量不止两个时,我们可以一样证明回归系数反映的是每一个自变量的独特贡献。

对于这个结论,标准化虽然有助于简化推理,却并不是必要条件。

但是以上关于回归系数的计算公式却假定自变量已标准化了,所以与原始数据所得的回归系数是不同的,它们是标准化了的回归系数。

当两个自变量没有相关性、相关系数为零时,情况以如何呢?

读者不难看到,此时r12=0,每个变量的单独贡献与组合在一起时的贡献是一样的。

回归系数也会等于相关系数(如果变量是标准化的)。

至此,我们从回归系数的角度解释了一个自变量在模型中的作用。

可以看出,回归系数反映的也是独特贡献。

当两个自变量是相关的,如果回归系数只反映了各自独特的贡献,那么公共的那部分信息跑哪里去了?

在以上的例子中,我们可以看到总的SSR(x1,x2)包含了公共的信息。

但是这部分信息没有被“记功”到x1或x2的回归系数上去。

这会导致什么样的结果呢?

我们可以预见,对于一个有两个自变量的模型,有的时候,R2可能很高,但是两个自变量都不显著;有的时候,R2可能很低,但是两个自变量都显著。

这取决于这两个自变量之间的信息重叠。

所以R2并不一定意味着所有的自变量都会显著,R2低也不见得意味着所有的自变量都不显著。

一个自变量与应变量有很高的相关性并不意味着它在一个更复杂的回归模型中会显著。

相反,如果我们希望我们的自变量是显著的,我们就必须保持自变量之间的相对独立性。

换句话讲,在一个回归模型中重复引入信息相似的自变量是不会增加这个模型的解释功能的,相反,其中有一些变量会显得不重要,因为“该说的都已经说了”。

就象这个例子一样:

易用性与易学性是同一个现象的两个侧面。

一个网店如果易用,那意味着它的使用对这个消费者来讲是易学的。

增加这个变量并不能显著增加模型的的解释能力。

更多的时候,自变量之间有信息重复,但各个自变量可能还是显著的。

这种“啰嗦”的模型,不但牺牲了简洁性,还会有其它副作用。

我们会在稍后解释。

偏决定系数与回归系数的关系

在讨论两个随机变量的关系的时候,我们已经提到过回归系数是两个变量的积和与自变量中的总信息的比例,至此,我们知道更准确的表述是一个自变量中的独特信息和应变量的积和与自变量中的独特信息的比例。

我们也提过回归系数是一个未经“按标准差标准化”的相关系数,而相关系数则是当我们对自变量和应变量都进行标准化后得到的。

我们有:

相应地,在两个自变量的回归时,如果我们去除x2与y中x1的信息,并对回归系数b2进行“按标准差标准化”,我们有:

。

可以证明(略),这个相关系数的平方就是偏决定系数。

所以这个相关系数就是偏相关系数ry2.1。

如果代入我们例子中的数值,可得

。

其平方为0.02。

而:

。

这样,我们对单变量与多变量回归中的回归系数与相关系数的关系有了一致的理解,即偏相关系数是标准化了的回归系数。

在单变量分析中唯一的不同是,我们“以全概偏”。

部分相关系数与方差分析

也可以表述为:

。

第一项又被叫作部分相关系数(partcorrelation)

。

它表示的是x2中的独特信息(按标准差标准化了)与应变量的积和与应变量总信息(而非剩余信息)之间的偏相关性。

从

去掉第二项意味着应变量中信息不是

而被看作是1。

也就是,我们所讲的是x2中的独特信息与y总信息的相关系数。

不难想象(读者可以根据SSR=SSR(x1)+SSR(x2|x1)这个关系自行证明),此时,应变量的总的R2是:

。

这表明,一个应变量中的被解释的总信息可以分解成两个部分:

由一个自变量所解释的部分与由另一个自变量中的独特信息所解释的部分。

只有当x1与x2是不相关的时候,才有:

。

如果我们以x2为应变量、x1为自变量回归,并把x2的残差对y作回归,我们可以得到:

y=5.79-0.29e(x2|x1)+e,R2=0.02

Model

SumofSquares

df

MeanSquare

F

Sig.

1

Regression

1.77

1

1.77

2.08

0.15

Residual

88.81

104

0.85

Total

90.58

105

a

Predictors:

(Constant),UnstandardizedResidual

b

DependentVariable:

trust

比较前面的模型,读者不难验证R2之间的关系。

当然,如果我们假定x2先进入模型,那么x1的额外贡献会很小。

所以方差分解可以有不同的分解步骤与变量的组合方式。

如果用一个圆来表示一个变量中的信息,我们可以用文氏图来表示变量之间的信息关系。

请读者思考SSR(x1,x2)、SSR(x1)、SSR(x2)、SSR(x2|x1)、R2、

、

如何对应于下图中的各部分之间的关系。

把一个应变量中的被解释的总信息分解成由一个自变量所解释的部分与由另一个自变量中的独特信息所解释的部分是一种分法。

从以上的文氏图中可以看出,我们其实也可能把应变量中的被解释的总信息分解成三个部分:

x1所解释的独特部分,

x2所解释的独特部分,二者的共同部分。

这是因为:

,

所以:

,

其中第三项为两个自变量的协方差。

在一个样本中,如果我们代入标准化时的b1,b2,且x1、x2的方差为1,协方差为r12,我们会得到(读者不难自行推导):

。

这里的b1、b2是标准化了的回归系数。

以上的公式表明一个应变量中被解释的信息是自变量与应变量相关系数的一个线性组合,而这个组合的系数是标准(化了的)回归系数(standardizedregressioncoefficient)。

路径图

假如研究者认为x1与x2同时影响y,而且这种影响是因果性的,我们可以把这种关系画成一个因果路径图。

这表示x1、x2、和其它随机因素e一起影响y。

这种路径图是理论模型的一的种约定的表述方式。

在这图中,箭头表示因果关系,箭头上的数值是标准回归系数。

有时候,我们会省略残差项e。

我们也往往在表示应变量的方框中加注R2。

我们会在以后广泛使用这种图示方法。

类别型自变量

有时候,自变量是类别型(categorical)或记名型的(nominal),比如性别、职业、宗教等等。

如何对这一类变量进行编码呢?

常用的方法有用哑元(dummyvariables)、未加权编码(unweightedeffectscoding)、加权编码(weightedeffectcoding)、与对比计划(plannedcontrasts)等方法。

在这理,我们将只介绍哑元法。

其它方法是实验设计的一种变化形式,我们会在实验设计中讨论它们的等价设计。

在大部分社会学研究中,自变量是连续变量。

类别型的自变量往往不是一个被感兴趣的理论变量,而是一个所谓的控制变量(controlvariable),比如性别、公司所在的行业。

在这种情况下,我们感兴趣的只是这个变量有没有对应变量有显著影响。

我们往往不对这个类别变量内部的不同(比如不同性别对网店的看法上的不同)感兴趣。

如果我们对类别变量的内部不同感兴趣,实验分析往往是一种更为直接的分析方法,我们会在实验设计中讨论这种情况。

所以,在这里,我们只讨论类别变量在回归中最基本的特征。

更多的细节可以参看(Cohenetal.,2003,chapter8)。

因为类别变量没有数值上的意义,最常见的处理是用一组哑元与编码。

对于性别,我们可以用一个哑元,比如以1代表男、0代表女。

如果我们有四个宗教,我们可以用三个哑元编码:

c1

c2

c3

天主教

0

0

0

新教

1

0

0

犹太教

0

1

0

其它

0

0

1

一般地,如果一个类别变量有g个值,我们用g-1个哑元就可以完全表示不同的类别取值。

用g个哑元是没有意义的,因为第g个哑元是其它哑元的线性组合,从而没有任何额外信息。

哑元编码要求类别之间是互斥互补的。

在以上的编码中,哑元全为零的类型被叫作参照组(referencegroup)。

那么我们应该以哪个组为参照组呢?

Hardy(1993)提出了三个方面:

第一,参照组应该是这些类别中的一个(就所期望的应变量而言)最大或者最小的参照类别(controlgroup);第二参照组不应该是一个没有明确意义的“垃圾筒”,比如以上的“其它”组;第三,参照组相对于其它的各组不应该有太小的样本量。

(这些规则不适用于其它方式的编码。

)编码以后,我们可以把这些哑元直接作为自变量加入到回归中去。

对于这个例子,我们需要在回归中增加三个自变量(哑元)。

在回归分析中,虽然增加的哑元的取值是二元的,所有关于相关系数、回归系数、回归系数的显著性(t值)、偏相关系数、部分相关系数、额外平方和等的计算并不需要改变,虽然简化的计算方法是存在的,但是,对回归系数的理解却与连续变量有所不同。

这是我们在这里要强调的重点。

我们先从只有哑元的最简单的形式开始。

以以上的宗教为例,假定一个类别变量有四个值、三个哑元,应变量是对堕胎的态度,我们有:

对于一个观察点,如果是:

天主教,那么:

,

新教,那么:

,

犹太教,那么:

,

其它,那么:

。

这表明这个回归方程与y轴的交点表示的是参照组的应变量均值,即天主教徒对堕胎的看法,而其它回归系数则是相应的类别与这个参照组的不同。

这就是这个“参照组”名称的由来。

这也在某种程度上解释了Hardy所提出的一些规则。

所以,一个回归系数所表示并不是一个类别对应变量“单位变化”,因为对于类别变量,单位是没有意义的。

回归系数是相对于参照组的变化;它表示的是组间的对比。

相应地,其显著性表示的是以参照组为基础的组间对比的显著性。

至此,读者可能会联想到传统的用于测试组间不同的t测试。

不难证明,bi的t值和第i组与天主教组的组间均值的t测试是等价的。

而这种方式的回归只是把一组具有相同参

- 配套讲稿:

如PPT文件的首页显示word图标,表示该PPT已包含配套word讲稿。双击word图标可打开word文档。

- 特殊限制:

部分文档作品中含有的国旗、国徽等图片,仅作为作品整体效果示例展示,禁止商用。设计者仅对作品中独创性部分享有著作权。

- 关 键 词:

- 定量 研究 方法论 多变 回归

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

《雷雨》中的蘩漪人物形象分析 1.docx

《雷雨》中的蘩漪人物形象分析 1.docx