信息论与编码授课教案.pdf

信息论与编码授课教案.pdf

- 文档编号:30838856

- 上传时间:2024-01-30

- 格式:PDF

- 页数:69

- 大小:2.56MB

信息论与编码授课教案.pdf

《信息论与编码授课教案.pdf》由会员分享,可在线阅读,更多相关《信息论与编码授课教案.pdf(69页珍藏版)》请在冰豆网上搜索。

袁怡圃袁怡圃授课授课教教案案2010年第2学期课程课程名称名称信息论与编码授课授课对象对象08通信时间时间3月9日,星期二1-2,第1周总计第1次课新内容新内容一、课程介绍一、课程介绍1.通信专业的专业基础课,理论性强2.数学基础:

概率论与数理统计3.学习任务:

学习信息论的基础知识;掌握信源编码、信道编码、加密编码的原理和方法。

4.学了之后:

更深的理解现代通信系统,对系统各功能实体有更明确的理解。

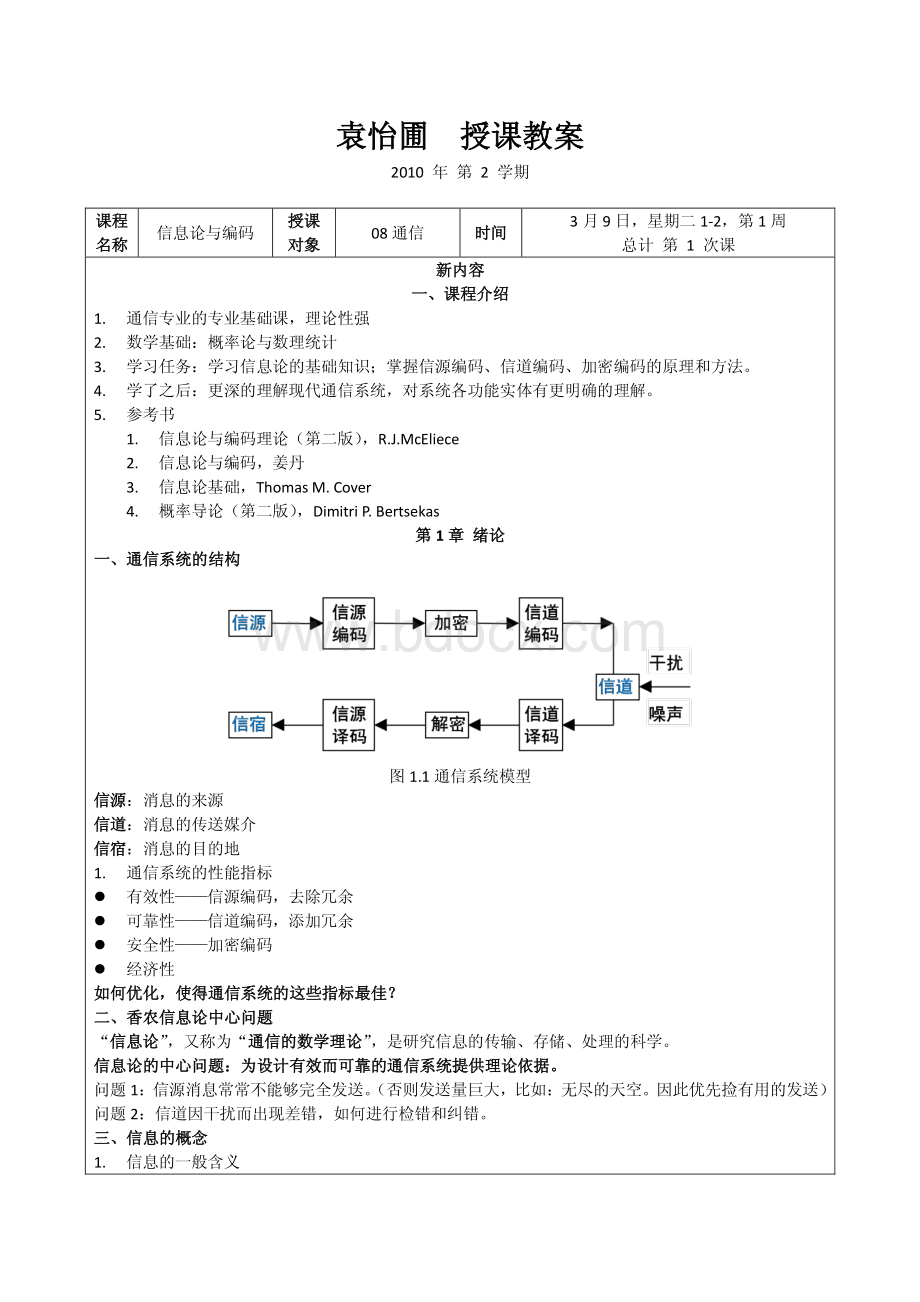

5.参考书1.信息论与编码理论(第二版),R.J.McEliece2.信息论与编码,姜丹3.信息论基础,ThomasM.Cover4.概率导论(第二版),DimitriP.Bertsekas第第1章章绪论绪论一、通信系统的结构一、通信系统的结构图1.1通信系统模型信源信源:

消息的来源信道信道:

消息的传送媒介信宿信宿:

消息的目的地1.通信系统的性能指标有效性信源编码,去除冗余可靠性信道编码,添加冗余安全性加密编码经济性如何优化,使得通信系统的这些指标最佳?

如何优化,使得通信系统的这些指标最佳?

二、香农信息论中心问题二、香农信息论中心问题“信息论信息论”,又称为“通信的数学理论通信的数学理论”,是研究信息的传输、存储、处理的科学。

信息论的中心问题:

为设计有效而可靠的通信系统提供理论依据。

信息论的中心问题:

为设计有效而可靠的通信系统提供理论依据。

问题1:

信源消息常常不能够完全发送。

(否则发送量巨大,比如:

无尽的天空。

因此优先捡有用的发送)问题2:

信道因干扰而出现差错,如何进行检错和纠错。

三、信息的概念三、信息的概念1.信息的一般含义“信息”是作为通信的消息来理解的。

在这种意义下,“信息”是人们在通信时所要告诉对方的某种内容。

“信息”是作为运算的内容而明确起来的。

在这种意义下,“信息”是人们进行运算和处理所需要的条件、内容和结果,并常常表现为数字、数据、图表和曲线等形式。

“信息”是作为人类感知的来源而存在的。

2.信息的本质“信息是关于事物运动的状态和规律信息是关于事物运动的状态和规律”。

或者说,是关于事物运动的“知识”。

在通信系统中,传送的本质内容是信息。

信息的基本概念在于它的不确定性信息的基本概念在于它的不确定性。

3.信息与消息、信号比较消息是信息的数学载体、信号是信息的物理载体信号:

具体的、物理的消息:

具体的、非物理的信息:

非具体的、非物理的四、补充:

信息大小的度量四、补充:

信息大小的度量1948年,美国一位数学家克劳特香农(C.EShannon)发表了一篇著名的论文通信的数学理论,解决了按“通信的消息”来理解的信息解决了按“通信的消息”来理解的信息(狭义信息狭义信息)的度量问题的度量问题。

香农的论文还给出了信息传输问题的一系列重要结果,建立了比较完整而系统的信息理论,这就是香农信息论香农信息论,也叫狭义信息论狭义信息论(简称“信息论”)。

香农信息理论的基本思路,大致可归结为以下三个基本观点:

1.非决定论观点根据通信问题研究对象的特点,信息理论按照非决定论的观点,采用了概率统计的方法采用了概率统计的方法,作为分析通信问题的数学工具。

2.形式化假说可提出如下的假设:

虽然信息的语义因素和语用因素对于广义信息来说并不是次要因素,但对于作为“通信的消息”来理解的狭义信息来说是次要因素。

因此,在描述和度量作为“通信的消息”来理解的狭义信息时,可以先把语义、语用因素搁置起来,假定各种信息的语义信息量和语用信息量恒定不变,假定各种信息的语义信息量和语用信息量恒定不变,而只单纯考虑信息的形式因素而只单纯考虑信息的形式因素。

3.不确定性人们要进行通信,不外有两种情形:

一是自己有某种形式的信息要告诉对方,同时估计对方既会对这种信息感到兴趣,而又尚不知道这个信息。

也就是说,对方在关于这个信息的知识上存在着不确定性;另一种情况是,自己有某种疑问要向对方询问,而且估计对方能够解答自己的疑问。

我们可以把作为“通信的消息”来理解的“狭义信息”,看作把作为“通信的消息”来理解的“狭义信息”,看作(或明确定义或明确定义)为一种用来消除通信对方为一种用来消除通信对方知识上的“不确定性”的东西知识上的“不确定性”的东西。

接收者收到某一消息后所获得的信息,可以用接收者在通信前后“不确定性”的消除量来度量。

简而言之,接收者所得到的信息量,在数量上等于通信前后“不确定性”的消除量收者所得到的信息量,在数量上等于通信前后“不确定性”的消除量(或减少量或减少量)。

不确定性是与“多种结果的可能性”相联系的,而在数学上,这些“可能性”正是以概率来度量的。

概率大,即“可能性”大;概率小,“可能性”小。

显然,“可能性”大,即意味“不确定性”小;“可能性”小,即意味“不确定性”大。

由此可见,“不确定性”与概率的大小存在着一定的联系,“不确定性”应该是概率的某一函数;那么,“不确定性”的消除量(减少量),也就是狭义信息量,也一定可由概率的某一函数表示。

狭义信息量,也一定可由概率的某一函数表示。

袁怡圃袁怡圃授课授课教教案案2010年第2学期课程课程名称名称信息论与编码授课授课对象对象08通信时间时间3月16日,星期二1-2,第2周总计第2次课复习复习信息的概念:

不确定性信息的概念:

不确定性收者所得到的信息量,在数量上等于通信前后“不确定性”的消除量(或减少量)。

狭义信息量,也一定可由概率的某一函数表示。

新内容新内容复习补充:

概率论知识复习补充:

概率论知识1、概率计算、概率计算()APA用频率代表概率。

古典概率;几何概率。

例题:

一个班级里,天才占60%,爱吃巧克力的占70%,既是天才又爱吃巧克力的占40%。

挑选一个既不是天才又不爱吃巧克力的学生的概率有多大?

解答:

设事件A为挑选一个天才学生,事件B为挑选一个爱吃巧克力的学生。

根据题意可知:

()0.6PA,(B)0.7P,(B)0.4PA题目所求为()()1()PABPABPAB()()()()0.60.70.40.9PABPAPBPAB所以()0.1PAB2、离散随机变量、离散随机变量试验结果的实值函数,取值范围有限个或可数无限个。

每一个取值,对应一个概率。

离散随机变量X的分布列()XPx表示Xx的概率。

例题:

随机投掷一个骰子,投掷一次所得的点数123456111111666666XP3、连续随机变量、连续随机变量概率密度函数()XPx,在区间,ab的概率()bXaPxdx。

4、联合概率分布、联合概率分布2个随机变量X,Y,联合分布列:

(,)(,)XYPxyPXxYy当两个随机变量相互独立时,,(,)()()XYXYPxyPxPy5、条件概率、条件概率()(|)()PABPABPB()(|)()PABPABPB例题:

连续投掷一个骰子2次。

已知总点数之和不大于4,求投掷“一双”的概率。

解答:

总点数不大于4的事件A:

(1,1),(1,2),(1,3),(2,1),(2,2),(3,1)点数为“一双”的事件B:

(1,1),(2,2)1(|)3PBA第第2章章信源与信息熵信源与信息熵2.1信源的描述与分类信源的描述与分类按照信源发出的消息在时间上和幅度上的分布情况:

离散无记忆信源离散无记忆信源:

所发出的各个符号之间是相互独立的,发出的符号序列中的各个符号之间没有统计关联性,各个符号的出现概率是它自身的先验概率。

离散有记忆信源离散有记忆信源:

发出的各个符号之间不是相互独立的,各个符号出现的概率是有关联的。

发出单个符号的离散信源发出单个符号的离散信源:

信源每次只发出一个符号代表一个消息;发出符号序列的离散信源发出符号序列的离散信源:

信源每次发出一组含两个以上符号的符号序列代表一个消息。

将以上两种分类结合,就有四种离散信源:

(1)发出单个符号的无记忆离散信源;

(2)发出符号序列的无记忆离散信源;(3)发出单个符号的有记忆离散信源;(4)发出符号序列的有记忆离散信源。

一类重要的符号序列有记忆离散信源马尔可夫信源马尔可夫信源2.1.1无记忆信源1.单个符号的离散无记忆信源单个符号的离散无记忆信源每次只发出一个符号代表一个消息;消息数量有限。

用一个离散随机变量离散随机变量X表示,数学模型:

1212()()()nnXaaaPpapapa12,nAaaaXA,01ipa,1()1niipa2.单个符号的连续无记忆信源单个符号的连续无记忆信源每次只发出一个符号代表一个消息,消息数量无限。

用一个连续随机变量连续随机变量X表示,数学模型:

(,)()XXabPPxor()XRPx()0,()1bXXapxpxdxor()1XRpxdx3.发出符号序列离散无记忆信源发出符号序列离散无记忆信源每次发出一组含两个以上的符号序列来代表一个消息。

数学模型:

信源输出用维随机序列(随机矢量)用维随机序列(随机矢量)12(,)lLXXXXX来描述信源输出的消息,用联合概联合概率率分布来表示信源特性。

在上述随机矢量中,若每个随机变量iX都是离散的,则可用重离散概率空间来描述这类信源。

111111()()()()nnnnnnXaaaaaaPpaaapaaa其中12(,)1,2,inXAaaaiL,这个空间共有Ln个元素。

因为序列无记忆,所以1212,LLpXXXpXpXpX若为平稳平稳随机序列,则121,LLLkkpXXXpXpX(概率不随时间变化,每个符号的概率分布相同)这种由信源X输出的L长随机序列X所描述的信源叫做离散无记忆信源离散无记忆信源X的的L次扩展信源次扩展信源。

2.1.2有记忆信源一般情况下,信源先后发出的符号之间是互相依赖的。

放在L维随机矢量的联合概率分布中,就必然要引入条件概率条件概率分布来说明它们之间的关联。

这种信源即有记忆信源。

实际上信源发出的符号往往只与前面几个符号的依赖关系较强,而与更前面的符号依赖关系就弱。

为此可以限制随机序列的记忆长度。

连续信源的离散化连续信源的离散化:

只要是频率或时间有限的随机过程,都可以通过采样将之变成时间上或频率上离散的连续符号序列。

(信号与系统课程详述采样定理)袁怡圃袁怡圃授课授课教教案案2010年第2学期课程课程名称名称信息论与编码授课授课对象对象08通信时间时间3月19日,星期五3-4,第2周总计第3次课复习复习信源的分类信源的分类

(1)发出单个符号的无记忆离散信源;

(2)发出符号序列的无记忆离散信源;(3)发出单个符号的有记忆离散信源;(4)发出符号序列的有记忆离散信源。

新内容新内容复习补充:

马尔科夫链复习补充:

马尔科夫链1、离散时间的马尔科夫链模型离散时间的马尔科夫链模型:

状态、转移概率该模型里,过去对未来的影响归结于对状态状态的影响,它的概率分布随着时间变化。

假设变量取值的状态变量取值的状态只取有限个值只取有限个值。

应用:

几乎全部动力系统,通信、自动化控制、信息传输、制造业、经济、运筹学等。

离散时间的马尔可夫链离散时间的马尔可夫链状态在确定的离散时间点上发生变化。

转移概率转移概率Pij:

当前状态i,下一个状态j的概率。

核心假设:

只要时刻n的状态为i,不论过去发生什么,不论如何达到状态i,下一个时刻转移到状态j的概率一定是转移概率Pij。

马尔可夫模型的性质:

马尔可夫模型的性质:

一个马尔可夫链模型由以下特征确定:

1.状态集合1,2,Sm2.可能发生状态转移(,)ij的集合,即由所有0ijP的,ij组成。

3.ijP的取值(取正值)。

由该模型描述的马尔可夫链是一个随机变量序列随机变量序列01,XX,它们取值于S,并且满足:

对于任意的时间n,所有状态以及所有之前可能的状态序列0,nii,均有11100(|,)nnnnijPxjxixixiP2、描述:

转移概率矩阵、转移概率图、描述:

转移概率矩阵、转移概率图马尔可夫链由转移概率矩阵转移概率矩阵刻画:

第i行,第j列的元素为Pij1111mmmmPPPP转移概率图转移概率图1.节点nodes:

表示状态2.连接节点的有向弧线arcs:

表示可能发生的转移3.Pij:

标在相应的弧线旁边例1:

爱丽丝上一门课程,每周可能进步也可能落后。

如果给定的一周,她进步了,那么后一周进步的概率为0.8,落后的概率为0.2;如果给定的一周,她落后了,那么后一周进步的概率为0.6,落后的概率为0.4;假设这些概率都不依赖她之前的每周的进步落后情况。

转移概率矩阵0.80.20.60.4转移概率图例2:

苍蝇和蜘蛛一只苍蝇在一条直线上移动(共4个单位),每次移动一个单位长度。

每单位时间,它以0.3的概率向左移动一个单位,以0.3的概率向右移动一个单位,以0.4的概率停留在原地。

两只蜘蛛等待在位置1和4,如果苍蝇到达这两个位置,它将被蜘蛛捕获,过程结束。

转移概率矩阵10000.30.40.3000.30.40.30001转移概率图3、n步变化:

路径的概率,步变化:

路径的概率,n步转移概率,步转移概率,C-K公式,公式,n步转移概率矩阵步转移概率矩阵路径的概率路径的概率计算未来任何一个给定状态序列的概率。

计算未来任何一个给定状态序列的概率。

01121001100(,)()nnnniiiiiiPxixixiPxiPPP图形上,一个状态序列能表示为在转移概率图中的一个转移弧线序列。

在给定初始状态下,该路径的概在给定初始状态下,该路径的概率等于每个弧线上转移概率的乘积。

率等于每个弧线上转移概率的乘积。

n步转移概率步转移概率定义:

0()(|)ijnrnPxixi计算在当前状态条件下,未来某个时期状态的概率分布。

计算在当前状态条件下,未来某个时期状态的概率分布。

当前状态i,n个时间段后的状态将是j的计算公式:

C-K方程方程1()

(1)mijijkjkrnrnP,其中

(1)ijijrP表示为矩阵:

RPPPP()nnC-K公式证明,应用全概率公式:

01010110111(|)(|)(|,)(|)(|)

(1)mnnnnkmnnnkmijkjkPxjxiPxkxiPxjxkxiPxkxiPxjxkrnPn步转移概率矩阵步转移概率矩阵:

()ijrn看成一个二维矩阵第i行第j列的元素。

讨论n时:

例1中,每一个()ijrn都收敛于一个极限值,不依赖于初始状态i。

0.750.25()0.750.25ijP例2中,()ijrn仍旧收敛,但是极限值依赖于初始状态,并且对于某特定的状态极限值可能为0。

10002/3001/3()1/3002/30000ijPMATLAB补充补充1:

矩阵的乘方:

矩阵的乘方【数值计算方法】1.50.80.2,?

0.60.4aaMATLAB命令:

a=0.8,0.2;0.6,0.4a52.310000.30.40.30,?

00.30.40.30001bbMATLAB命令:

b=1,0,0,0;0.3,0.4,0.3,0;0,0.3,0.4,0.3;0,0,0,1b3【符号计算】3.50.80.2,?

0.60.4aaMATLAB命令:

a=sym(0.8,0.2;0.6,0.4)a54.310000.30.40.30,?

00.30.40.30001bbMATLAB命令:

b=sym(1,0,0,0;0.3,0.4,0.3,0;0,0.3,0.4,0.3;0,0,0,1)b3袁怡圃袁怡圃授课授课教教案案2010年第2学期课程课程名称名称信息论与编码授课授课对象对象08通信时间时间3月23日,星期二1-2,第3周总计第4次课复习复习1、概念:

转移概率、转移概率矩阵、转移概率图、概念:

转移概率、转移概率矩阵、转移概率图例3:

一个教授抽取测试卷子。

卷子的难度分成3种:

困难、中等和容易。

如果本次抽到的困难的卷子,则下次分别有0.5的概率抽中中等和容易的卷子。

如果本次抽到的是中等的卷子,则下次仍旧0.5的概率为中等难度,另外有0.25的概率抽中困难或容易的卷子。

如果本次抽到的是容易的卷子,则下次仍旧0.5的概率为容易难度,另外有0.25的概率抽中困难或中等的卷子。

转移概率矩阵00.50.50.250.50.250.250.250.5P转移概率图2、n步转移概率矩阵计算步转移概率矩阵计算上题的10步转移概率矩阵为:

5(5)PP新内容新内容复习补充:

马尔科夫链复习补充:

马尔科夫链4、状态的分类:

常返类、非周期状态的分类:

常返类、非周期可达的可达的如果对于某一个n,n步转移概率()ijrn是正的,则称状态j为从状态i可达的。

常返态常返态:

对于每个从i出发可达的状态j,相应的从j出发也可达i,那么状态i称为常返的。

如果一个状态不是常返的,我们称之为非常返的非常返的。

如果i是常返态,那么从i可达的状态集合()Ai组成一个常返类常返类。

单个常返类一个非常返态(3)和一个常返类(1,2)两个非常返态(2,3)和两个常返类马尔可夫链的分解马尔可夫链的分解一个马尔可夫链的状态集合可以分解成一个或多个常返类,加上可能的一些非常返状态。

一个常返态从它所属的类里任何一个状态出发是可达的,但从其他类里的常返状态出发是不可达的。

从任何一个常返状态出发都不可到达非常返状态。

从一个非常返状态出发,至少有一个或多个常返态是可达的。

常返类的周期性常返类的周期性:

一个状态被回访时间是否出现周期性。

如果一个常返类的状态可被分成d1个互不相交的子集,且满足所有的转移都是从一个这样的子集到下一个,我们称这个常返类是周期的。

周期的。

如果一个常返类不具有周期,称为非周期非周期的。

判定方法:

5、稳态性质:

研究对象、计算方法稳态性质:

研究对象、计算方法研究对象:

一个常返类,并且不是周期的。

单个常返类的链也可能是不收敛的,比如具有周期的常返类。

稳态收敛定理稳态收敛定理:

考虑一个非周期的,单个常返类的马尔可夫链,那么,状态j和它对应的稳态概率jW具有如下性质:

1、对于每个j有lim()ijjnrnW2、是下面方程组的唯一解:

1mjkkjkWWp11mkkW3、另外有0jW,对于所有的非常返状态j0jW,对于所有的常返状态j写作矩阵乘法:

111111001111mmmmppWWpmp,可用MATLAB解决。

MATLAB补充补充2:

线性方程组的求解:

线性方程组的求解求解23333252xyzxyzxyz方法1:

该线性方程组可改写为矩阵乘法方式235311322131xyzMATLAB命令:

【数值计算方法】A=2,3,5;3,1,-1;-1,3,-1b=3,2,2x=b/A结果:

x=0.51520.6364-0.0606MATLAB命令:

【符号计算】A=sym(2,3,5;3,1,-1;-1,3,-1)b=sym(3,2,2)x=b/A结果:

x=17/33,7/11,-2/33方法2:

该线性方程组可改写为另一种矩阵乘法方式231331325112xyzMATLAB命令:

【数值计算方法】A=2,3,-1;3,1,3;5,-1,-1b=3;2;2x=Ab结果:

x=0.51520.6364-0.0606MATLAB命令:

【符号计算】A=sym(2,3,-1;3,1,3;5,-1,-1)b=sym(3;2;2)x=Ab结果:

x=17/337/11-2/33袁怡圃袁怡圃授课授课教教案案2010年第2学期课程课程名称名称信息论与编码授课授课对象对象08通信时间时间3月30日,星期二1-2,第4周总计第5次课复习复习马尔科夫链稳态性质计算方法马尔科夫链稳态性质计算方法例题:

已知马尔可夫链的转移概率矩阵,求其稳态概率。

1/21/2001/32/31/504/5P解答:

设稳态概率为123WWWW,构造矩阵1/211/20101/312/311/504/511Q,0001B利用MATLAB求解W=B/Q新内容新内容2.1.3马尔可夫信源马尔可夫信源当记忆长度为m+1时,称这种有记忆信源为m阶马尔可夫信源阶马尔可夫信源。

也就是信源所发出的符号只与前m个符号有关,与更前面的符号无关。

这样就可用马尔可夫链来描述信源。

这时描述符号之间依赖关系的条件概率可表述为1212112121121211122121(,)(|,)(,)(|,)(,)(|,)(|,)(,)LLLLLLmLLLLmLLLmLLpxxxpxxxxpxxxpxxxxpxxxpxxxxpxxxxpxxx如果条件概率与时间起点无关,则信源输出的消息可看成齐次马尔可夫链齐次马尔可夫链,这样的信源称为齐次马齐次马尔可夫信源尔可夫信源。

最简单的马尔可夫信源是当m=1,也就是一阶马尔可夫信源一阶马尔可夫信源,此时:

12112211,LLLLLpxxxpxxpxxpxxpx对于高阶马尔可夫链,我们可通过分析系统状态在输入符号作用下的转移情况,使高阶马尔可夫链过程转化为一阶马尔可夫链过程。

对于m阶马尔可夫信源,将该时刻以前出现的m个符号组成的序列定义为状态is,即121212,mmiiiiiiinsxxxxxxAaaa状态集12,mQSsssQn。

则前面我们提到的条件概率可转变为符号条件概率状态转移概率1,2,1,2,1,2,jijipxsjniQpssijQ更一般的,在时刻m系统处于状态is的条件下,经n-m步后转移到状态js的概率用状态转移概率状态转移概率(,)ijpmn表示:

ijnjmijiijpmnPSsSsPssssS

(1)当n-m=1时,为基本转移概率或称为一步转移概率简记为11,1,ijmjmiijmmpmmPSsSspmPSjSiijS对于齐次马尔可夫链,与时刻m无关ijijpmp。

(2)类似的,定义k步转移概率步转移概率为(),kkijmkmijpmPSjSipijS一步齐k步次,ijijkkijijijpmppmnpmp注:

平稳信源的概率分布特性具有时间推移不变性,而齐次马氏链只要转移概率具有时间推移不变性,因此一般情况下,平稳包含齐次。

由于系统在任一时刻可处于状态空间12,QSsss的任意状态,因此状态转移时,转移概率是一个矩阵,即:

kQQijPpmijS对于齐次马尔可夫信源,由一步转移概率ijp可写出其转移矩阵为,QQijPpijS1111QQQQppPpp切普曼切普曼-柯尔莫郭洛夫(柯尔莫郭洛夫(Chapman-kormotopob)方程(针对齐次马尔可夫链)方程(针对齐次马尔可夫链)()kkllijirrjrppp特别的,1l,1

(1)kkkijirrjirrjrrppppp若用矩阵表示PPPPPPP12()kkkk对于齐次马尔可夫链,一步转移概率完全决定了k步转移概率。

遍历马尔可夫链(遍历马尔可夫链(limkijkp存在)的条件存在)的条件有唯一解不可约性非周期性iijjiWpW

(1)通过1iijjijjWpWW解出12,QWWW

(2)不可约性:

对任一,ij都存在至少一个k,使0kijp,就是说从is开始,总有可能到达js。

(3)非周期性:

所有0kiip的n中没有比1大的公因子。

2.2离散信源熵和互信息离散信源熵和互信息2.2.1自信息量信源发出某一

- 配套讲稿:

如PPT文件的首页显示word图标,表示该PPT已包含配套word讲稿。双击word图标可打开word文档。

- 特殊限制:

部分文档作品中含有的国旗、国徽等图片,仅作为作品整体效果示例展示,禁止商用。设计者仅对作品中独创性部分享有著作权。

- 关 键 词:

- 信息论 编码 授课 教案

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

江南大学现代远程教育 考试大作业1.docx

江南大学现代远程教育 考试大作业1.docx

美术开学第一课-二年级.pptx

美术开学第一课-二年级.pptx