MapReduce经典例子WordCount运行详解.docx

MapReduce经典例子WordCount运行详解.docx

- 文档编号:28425716

- 上传时间:2023-07-13

- 格式:DOCX

- 页数:37

- 大小:343.17KB

MapReduce经典例子WordCount运行详解.docx

《MapReduce经典例子WordCount运行详解.docx》由会员分享,可在线阅读,更多相关《MapReduce经典例子WordCount运行详解.docx(37页珍藏版)》请在冰豆网上搜索。

MapReduce经典例子WordCount运行详解

创建时间:

2012/3/1

修改时间:

2017/3/1修改次数:

0

HadoopMapReduce经典例子

——WordCount运行详解

1、MapReduce理论简介

1.1MapReduce编程模型

MapReduce采用“分而治之”的思想,把对大规模数据集的操作,分发给一个主节点

管理下的各个分节点共同完成,然后通过整合各个节点的中间结果,得到最终结果。

简单地

说,MapReduce就是“任务的分解与结果的汇总”。

在Hadoop中,用于执行MapReduce任务的机器角色有两个:

一个是JobTracker;另一

个是TaskTracker,JobTracker是用于调度工作的,TaskTracker是用于执行工作的。

一个Hadoop

集群中只有一台JobTracker。

在分布式计算中,MapReduce框架负责处理了并行编程中分布式存储、工作调度、负

载均衡、容错均衡、容错处理以及网络通信等复杂问题,把处理过程高度抽象为两个函数:

map和reduce,map负责把任务分解成多个任务,reduce负责把分解后多任务处理的结果汇

总起来。

需要注意的是,用MapReduce来处理的数据集(或任务)必须具备这样的特点:

待处

理的数据集可以分解成许多小的数据集,而且每一个小数据集都可以完全并行地进行处理。

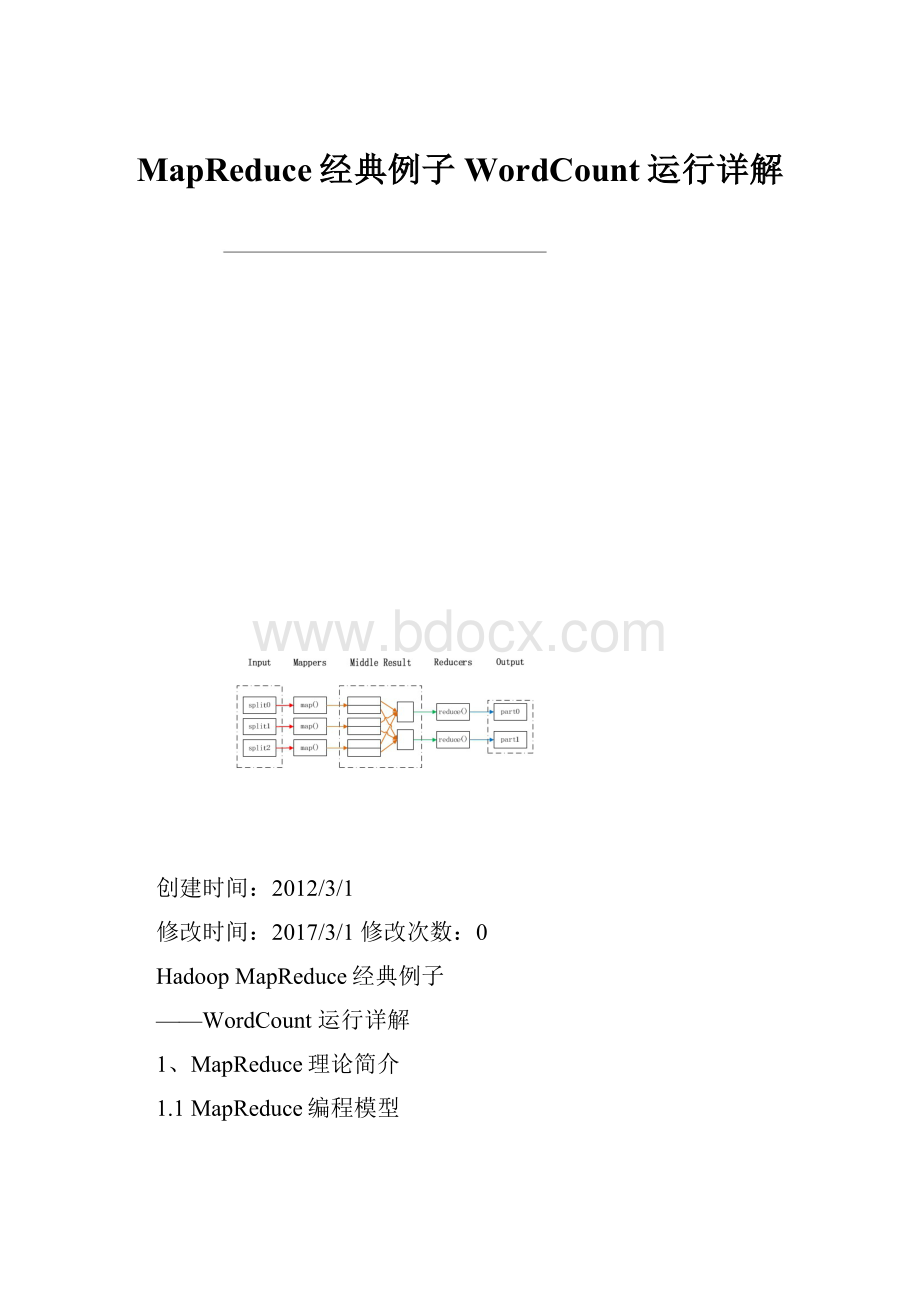

1.2MapReduce处理过程

在Hadoop中,每个MapReduce任务都被初始化为一个Job,每个Job又可以分为两种

阶段:

map阶段和reduce阶段。

这两个阶段分别用两个函数表示,即map函数和reduce函

数。

map函数接收一个

出,Hadoop函数接收一个如

理,每个reduce产生0或1个输出,reduce的输出也是

MapReduce处理大数据集的过程

1

创建时间:

2012/3/1

修改时间:

2017/3/1修改次数:

0

2、运行WordCount程序

单词计数是最简单也是最能体现MapReduce思想的程序之一,可以称为MapReduce版

“HelloWorld”,该程序的完整代码可以在Hadoop安装包的“src/examples”目录下找到。

单词计数主要完成功能是:

统计一系列文本文件中每个单词出现的次数,如下图所示。

2.1准备工作

现在以“hadoop”普通用户登录“Master.Hadoop”服务器。

1)创建本地示例文件

首先在“/home/hadoop”目录下创建文件夹“file”。

接着创建两个文本文件file1.txt和file2.txt,file1.txt内容为使“HelloWorld”而file2.txt,

的内容为“HelloHadoop”。

2

创建时间2012/3/1

修改时间:

2017/3/1修改次数:

0

2)在HDFS上创建输入文件夹

3)上传本地file中文件到集群的input目录下

2.2运行例子

1)在集群上运行WordCount程序

备注:

以input作为输入目录,output目录作为输出目录。

已经编译好的WordCount的Jar在“/usr/hadoop”下面,“hadoop-examples-1.0.0.jar”就是,

所以在下面执行命令时记得把路径写全了,不然会提示找不到该Jar包。

2)MapReduce执行过程显示信息

Hadoop命令会启动一个JVM来运行这个MapReduce程序,并自动获得Hadoop的配置,

同时把类的路径(及其依赖关系)加入到Hadoop的库中。

以上就是HadoopJob的运行记录,

从这里可以看到,这个Job被赋予了一个ID号:

job_201202292213_0002,而且得知输入文

件有两个(Totalinputpathstoprocess:

2),同时还可以了解map的输入输出记录(record数

及字节数),以及reduce输入输出记录。

比如说,在本例中,map的task数量是2个,reduce

3

创建时间:

2012/3/1

修改时间:

2012/3/1修改次数:

0

的task数量是一个。

map的输入record数是2个,输出record数是4个等信息。

2.3查看结果

1)查看HDFS上output目录内容

从上图中知道生成了三个文件,我们的结果在“part-r-00000”中。

2)查看结果输出文件内容

3、WordCount源码分析

3.1特别数据类型介绍

Hadoop提供了如下内容的数据类型,这些数据类型都实现了WritableComparable接口,

以便用这些类型定义的数据可以被序列化进行网络传输和文件存储,以及进行大小比较。

BooleanWritable:

标准布尔型数值

ByteWritable:

单字节数值

DoubleWritable:

双字节数

FloatWritable:

浮点数

IntWritable:

整型数

LongWritable:

长整型数

Text:

使用UTF8格式存储的文本

NullWritable:

当

3.2旧的WordCount分析

1)源代码程序

packageorg.apache.hadoop.examples;

4

创建时间:

2012/3/1

修改时间:

2012/3/1修改次数:

0

importjava.io.IOException;

importjava.util.Iterator;

importjava.util.StringTokenizer;

importorg.apache.hadoop.fs.Path;

importorg.apache.hadoop.io.IntWritable;

importorg.apache.hadoop.io.LongWritable;

importorg.apache.hadoop.io.Text;

importorg.apache.hadoop.mapred.FileInputFormat;

importorg.apache.hadoop.mapred.FileOutputFormat;

importorg.apache.hadoop.mapred.JobClient;

importorg.apache.hadoop.mapred.JobConf;

importorg.apache.hadoop.mapred.MapReduceBase;

importorg.apache.hadoop.mapred.Mapper;

importorg.apache.hadoop.mapred.OutputCollector;

importorg.apache.hadoop.mapred.Reducer;

importorg.apache.hadoop.mapred.Reporter;

importorg.apache.hadoop.mapred.TextInputFormat;

importorg.apache.hadoop.mapred.TextOutputFormat;

public

{

class

WordCount

public

{

private

private

staticclassMapextendsMapReduceBase

Mapper

finalstaticIntWritableone=new

Textword=newText();

implements

IntWritable

(1);

public

voidmap(LongWritablekey,Textvalue,

OutputCollector

throwsIOException

{

Stringline=value.toString();

StringTokenizertokenizer=newStringTokenizer(line);

while(tokenizer.hasMoreTokens())

{

word.set(tokenizer.nextToken());

output.collect(word,one);

}

}

}

5

创建时间:

2012/3/1

修改时间:

2012/3/1修改次数:

0

public

{

staticclassReduceextendsMapReduceBase

Reducer

implements

public

voidreduce(Textkey,Iterator

OutputCollector

throwsIOException

{

intsum=0;

while(values.hasNext())

{

sum+=values.next().get();

}

output.collect(key,newIntWritable(sum));

}

}

publicstaticvoidmain(String[]args)throwsException

{

JobConfconf=newJobConf(WordCount.class);

conf.setJobName("wordcount");

conf.setOutputKeyClass(Text.class);

conf.setOutputValueClass(IntWritable.class);

conf.setMapperClass(Map.class);

conf.setCombinerClass(Reduce.class);

conf.setReducerClass(Reduce.class);

conf.setInputFormat(TextInputFormat.class);

conf.setOutputFormat(TextOutputFormat.class);

FileInputFormat.setInputPaths(conf,newPath(args[0]));

FileOutputFormat.setOutputPath(conf,newPath(args[1]));

JobClient.runJob(conf);

}

}

3)主方法Main分析

public

{

static

void

main(String[]args)throwsException

JobConfconf=newJobConf(WordCount.class);

conf.setJobName("wordcount");

6

创建时间:

2012/3/1

修改时间:

2012/3/1修改次数:

0

conf.setOutputKeyClass(Text.class);

conf.setOutputValueClass(IntWritable.class);

conf.setMapperClass(Map.class);

conf.setCombinerClass(Reduce.class);

conf.setReducerClass(Reduce.class);

conf.setInputFormat(TextInputFormat.class);

conf.setOutputFormat(TextOutputFormat.class);

FileInputFormat.setInputPaths(conf,newPath(args[0]));

FileOutputFormat.setOutputPath(conf,newPath(args[1]));

JobClient.runJob(conf);

}

首先讲解一下Job的初始化过程。

main函数调用Jobconf类来对MapReduceJob进行

初始化,然后调用setJobName()方法命名这个Job。

对Job进行合理的命名有助于更快地找

到Job,以便在JobTracker和Tasktracker的页面中对其进行监视。

JobConfconf=newJobConf(WordCount.class);

conf.setJobName("wordcount");

接着设置Job输出结果

所以key设置为“Text”类型,相当于Java中String类型。

Value设置为“IntWritable”,相

当于Java中的int类型。

conf.setOutputKeyClass(Text.class);

conf.setOutputValueClass(IntWritable.class);

然后设置Job处理的Map(拆分)、Combiner(中间结果合并)以及Reduce(合并)的

相关处理类。

这里用Reduce类来进行Map产生的中间结果合并,避免给网络数据传输产生

压力。

conf.setMapperClass(Map.class);

conf.setCombinerClass(Reduce.class);

conf.setReducerClass(Reduce.class);

接着就是调用setInputPath()和setOutputPath()设置输入输出路径。

conf.setInputFormat(TextInputFormat.class);

conf.setOutputFormat(TextOutputFormat.class);

7

创建时间:

2012/3/1

修改时间:

2012/3/1修改次数:

0

(1)InputFormat和InputSplit

InputSplit是Hadoop定义的用来传送给每个单独的map的数据,InputSplit存储的并非

数据本身,而是一个分片长度和一个记录数据位置的数组。

生成InputSplit的方法可以通过

InputFormat()来设置。

当数据传送给map时,map会将输入分片传送到InputFormat,InputFormat则调用方

法getRecordReader()生成RecordReader,RecordReader再通过creatKey()、creatValue()

方法创建可供map处理的

简而言之,InputFormat()方法是用来生成可供map

处理的

Hadoop预定义了多种方法将不同类型的输入数据转化为map能够处理的

对,它们都继承自InputFormat,分别是:

InputFormat

|

|---BaileyBorweinPlouffe.BbpInputFormat

|---ComposableInputFormat

|---CompositeInputFormat

|---DBInputFormat

|---DistSum.Machine.AbstractInputFormat

|---FileInputFormat

|---CombineFileInputFormat

|---KeyValueTextInputFormat

|---NLineInputFormat

|---SequenceFileInputFormat

|---TeraInputFormat

|---TextInputFormat

其中TextInputFormat是Hadoop默认的输入方法,TextInputFormat中,在每个文件(或

其一部分)都会单独地作为map的输入,而这个是继承自FileInputFormat的。

之后,每行

数据都会生成一条记录,每条记录则表示成

key值是每个数据的记录在数据分片中字节偏移量,数据类型是LongWritable;

value值是每行的内容,数据类型是Text。

(2)OutputFormat

每一种输入格式都有一种输出格式与其对应。

默认的输出格式是TextOutputFormat,

这种输出方式与输入类似,会将每条记录以一行的形式存入文本文件。

不过,它的键和值可

以是任意形式的,因为程序内容会调用toString()方法将键和值转换为String类型再输出。

3)Map类中map方法分析

public

{

private

private

finalstaticIntWritableone=new

Textword=newText();

IntWritable

(1);

staticclassMapextendsMapReduceBaseimplements

Mapper

8

创建时间:

2012/3/1

修改时间:

2012/3/1修改次数:

0

public

voidmap(LongWritablekey,Textvalue,

OutputCollector

throwsIOException

{

Stringline=value.toString();

StringTokenizertokenizer=newStringTokenizer(line);

while(tokenizer.hasMoreTokens())

{

word.set(tokenizer.nextToken());

output.collect(word,one);

}

}

}

Map类继承自MapReduceBase,并且它实现了Mapper接口,此接口是一个规范类型,

它有4种形式的参数,分别用来指定map的输入key值类型、输入value值类型、输出key

值类型和输出value值类型。

在本例中,因为使用的是TextInputFormat,它的输出key值是

LongWritable类型,输出value值是Text类型,所以map的输入类型为

在本例中需要输出

型是IntWritable。

实现此接口类还需要实现map方法,map方法会具体负责对输入进行操作,在本例中,

map方法对输入的行以空格为单位进行切分,然后使用OutputCollect收集输出的

4)Reduce类中reduce方法分析

public

{

public

voidreduce(Textkey,Iterator

OutputCollector

throwsIOException

staticclassReduceextendsMapReduceBaseimplements

Reducer

{

intsum=0;

while(values.hasNext())

{

sum+=values.next().get();

}

output.collect(key,newIntWritable(sum));

}

}

Reduce类也是继承自MapReduceBase的,需要实现Reducer接口。

Reduce类以map

的输出作为输入,因此Reduce的输入类型是

而Reduce的输出是单词

9

和它的数目,因此,它的输出类型是

Reduce类也要实现reduce方法,

在此方法中,reduce函数将输入的key值作为输出的key值,然后将获得多个value值加起

来,作为输出的值。

3.3新的WordCount分析

1)源代码程序

packageorg.apache.hadoop.examples;

importjava.io.IOException;

importjava.util.StringTokenizer;

importorg.apache.hadoop.conf.Configuration;

importorg.apache.hadoop.fs.Path;

importorg.apache.hadoop.io.IntWritable;

importorg.apache.hadoop.io.Text;

importorg.apache.hadoop.mapreduce.Job;

importorg.apache.hadoop.mapreduce.Mapper;

importorg.apache.hadoop.mapreduce.Reducer;

importorg.apache.hadoop.mapreduce.lib.input.FileInputFormat;

importorg.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

importorg.apache.hadoop.util.GenericOptionsParser;

publicclassWordCount{

publicstaticclassTokenizerMapper

extendsMapper

- 配套讲稿:

如PPT文件的首页显示word图标,表示该PPT已包含配套word讲稿。双击word图标可打开word文档。

- 特殊限制:

部分文档作品中含有的国旗、国徽等图片,仅作为作品整体效果示例展示,禁止商用。设计者仅对作品中独创性部分享有著作权。

- 关 键 词:

- MapReduce 经典 例子 WordCount 运行 详解

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

《贝的故事》教案4.docx

《贝的故事》教案4.docx