阳洁翻译.docx

阳洁翻译.docx

- 文档编号:27041370

- 上传时间:2023-06-26

- 格式:DOCX

- 页数:12

- 大小:60.06KB

阳洁翻译.docx

《阳洁翻译.docx》由会员分享,可在线阅读,更多相关《阳洁翻译.docx(12页珍藏版)》请在冰豆网上搜索。

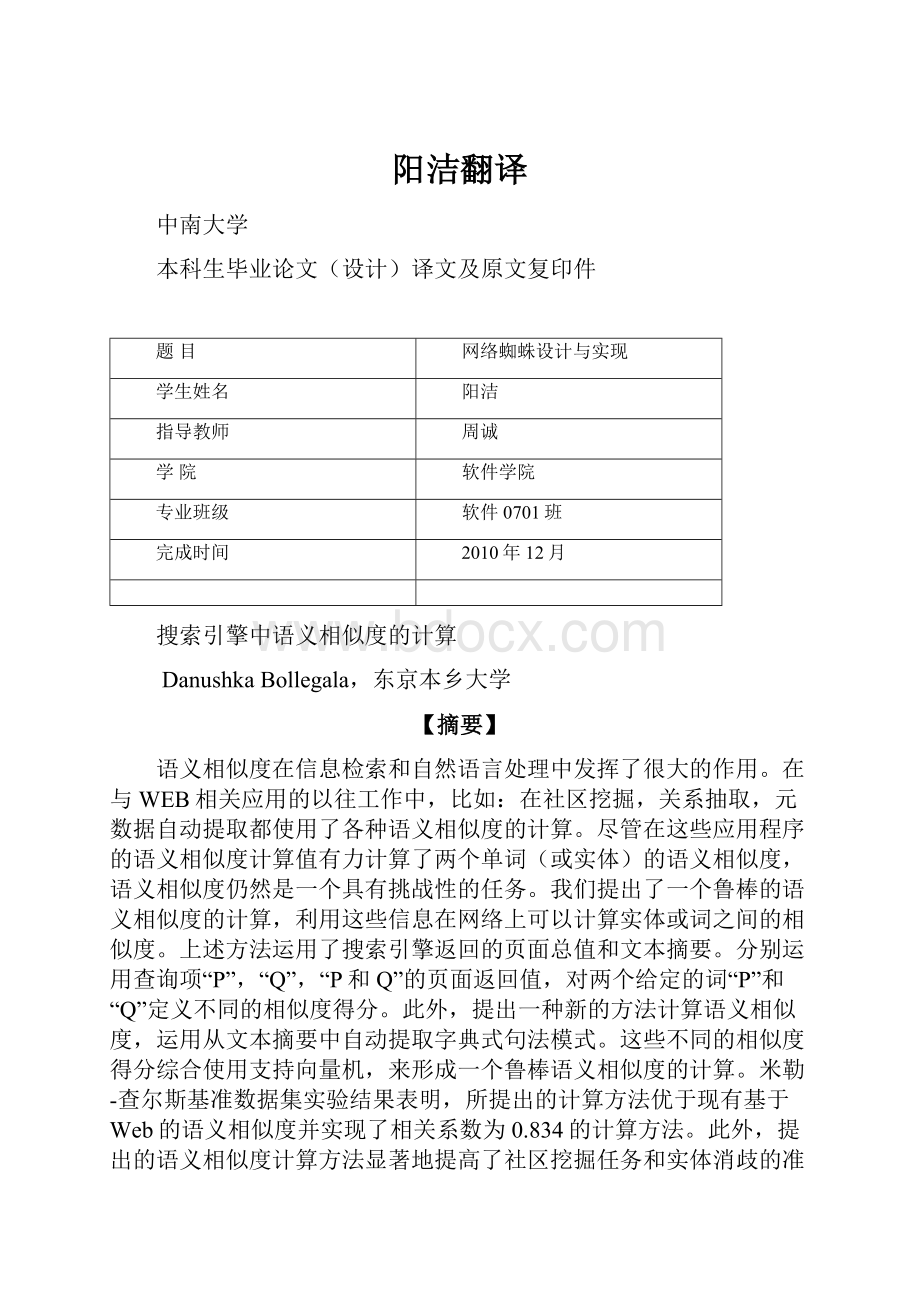

阳洁翻译

中南大学

本科生毕业论文(设计)译文及原文复印件

题目

网络蜘蛛设计与实现

学生姓名

阳洁

指导教师

周诚

学院

软件学院

专业班级

软件0701班

完成时间

2010年12月

搜索引擎中语义相似度的计算

DanushkaBollegala,东京本乡大学

【摘要】

语义相似度在信息检索和自然语言处理中发挥了很大的作用。

在与WEB相关应用的以往工作中,比如:

在社区挖掘,关系抽取,元数据自动提取都使用了各种语义相似度的计算。

尽管在这些应用程序的语义相似度计算值有力计算了两个单词(或实体)的语义相似度,语义相似度仍然是一个具有挑战性的任务。

我们提出了一个鲁棒的语义相似度的计算,利用这些信息在网络上可以计算实体或词之间的相似度。

上述方法运用了搜索引擎返回的页面总值和文本摘要。

分别运用查询项“P”,“Q”,“P和Q”的页面返回值,对两个给定的词“P”和“Q”定义不同的相似度得分。

此外,提出一种新的方法计算语义相似度,运用从文本摘要中自动提取字典式句法模式。

这些不同的相似度得分综合使用支持向量机,来形成一个鲁棒语义相似度的计算。

米勒-查尔斯基准数据集实验结果表明,所提出的计算方法优于现有基于Web的语义相似度并实现了相关系数为0.834的计算方法。

此外,提出的语义相似度计算方法显著地提高了社区挖掘任务和实体消歧的准确值(值为0.78的F测量),从而验证了提出的计算方法运用web内容获取语义相似度的能力。

种类和主题描述符

H.3.3[信息系统]:

信息查询与检索

总体概念

算法

关键字

语义相似度,web挖掘

*该工作得到了国际万维网委员会的支持(IW3C2),只可用于个人或教学使用。

WWW,8月8日—8月12日,2007,班夫、亚伯达省,加拿大。

ACM978-1-59593-654-7/07/0005

1.介绍

词语之间的语义相似度研究一直以来都是信息检索和自然语言处理中一个不可或缺的部分。

实体之间的语义相似度随时间和作用域的变化而改变。

例如:

在网络上,“苹果”会经常和“计算机”联系起来。

然而,这种对“苹果”的理解在通用的叙词表和字典上却找不到。

在网络上搜索“苹果”的用户,也许是对“苹果”的另一层意思感兴趣,而不是对一种叫做“苹果”的水果。

新创建的词汇和现有词汇新增加的含义,通过人工操作收集新词汇和增加新含义来维护叙词表代价非常高。

在使用搜索引擎的时候,我们提出一个自动的方法来计算词汇之间与实体之间的语义相似度。

由于文档数量巨大和网络的高增长速度,很难对每个文档进行单独和直接分析。

搜索引擎对这些庞大的信息提供了一个有效地接口。

搜索引擎提供了页面返回值和网页摘要这两个有效信息源。

查询项的页面返回值是那些含有查询词的网页的数量值。

查询项P和Q反回的总页数被认为是词P和Q共同出现的一个全局计算值。

比如,在google中查询“苹果”和“计算机”返回的总页数是2880,00000。

但是“香蕉”和“计算机”的返回总页数是3590000。

“苹果”和“计算机”的返回总页数是后者的80倍甚至还要多意味着“苹果”比“香蕉”与“计算机”在语义上有更大的相似度。

尽管上述方法很简单,单独用两个词共同出现的网页返回值进行计算会带来一些缺陷。

第一点,返回页总数分析忽略了词在页面中出现的位置,即使两个词出现在同一个页面,或许它们并没有联系。

第二点,一个多义词(一个词有很多种含义)可能包含所有的含义组合。

比如,“苹果”的返回页总数包含“苹果”作为一种水果和苹果作为一家公司的返回页总数。

此外,考虑到网络的规模和噪声,一些词可能随意的出现,即,偶然的时候,在一些页面上。

基于上述原因,单独将页面返回值计算语义相似度是不可靠的。

摘要是由搜索引擎从那些与查询项相关的文档提取出来的简要文本信息,提供了查询项局部语境有效的信息。

基于摘要定义语义相似度计算,已经运用在查询扩展[36],个人姓名消歧[4]与社区挖掘[6]。

处理摘要是非常有效地,因为它避免了下载网页将遇到的页面量的大小决定了耗时的多少等问题。

然而,一个普遍承认使用摘要的缺点是,由于结果集中巨额的文档以及大量的网络资源,摘要只对查询排名靠前的结果可以有效地处理。

排名搜索结果,因此,摘要是由搜索引擎指定的一系列因素所决定的。

因此,并不能保证一组指定的词中含有我们需要计算语义相似度的信息。

这篇论文提出了一种结合返回页总数与从摘要中抽取的字典式句法模式,因此,可以解决上述问题。

比如,让我们开始看在google中查询“jaguar”和“cat”后的网页摘要:

“TheJaguaristhelargestcatinWesternHemisphereandcansubduelargerpreythancanthepuma”

这里,以上短语是很大程度上表明着ahypernymic在“美洲虎”与“猫”之间的关系。

就如我们所知的以上短语是各种语义关系的一个例子。

以上示例已经被运用到很多工作中并取得了很好的效果,比如下义提取[12]以及事实提取[27]。

根据先前的例子,我们形成了X是最大Y的样本,然后我们用通配符X和Y来替换“美洲虎”与“猫”这两个单词。

这篇论文包括两个方面:

提出一种自动提取基于字典式句法模式方法计算从搜索引擎上获取的文本摘要的语义相似度。

综合不同基于网络的相似计算运用WordNet同义词集和支持向量机去创建健全的语义相似度计算方法。

这种综合计算方法将优于现所存在的基于网络语义相似度计算在基准数据集中。

据我们所知,这是第一次尝试去结合wordNet的同义词集与网络内容利用健全的语义相似度计算。

本文其余部分组织如下,在第二部分中,我们讨论的先前工作有关语义相似计算。

然后,我们在第三部分提出来相应的方法,第四部分对提出来的方法与先前基于网络语义相似度计算以及设定的基准数据的几个基线方法进行了比较,为了评价新提出来的方法在确定现实世界中实体的语义相似度,我们将它运用的社区挖掘的工作中。

最后,我们可以证明新提出来的方法对容易引起歧义的实体二义性的消除非常有用,然后结束本文。

2.相关工作

语义相似度计算在很多与网络相关的工作中非常的重要。

在查询扩展[5,25,40]中,一个用户查询被改进成用近义词去提高查询的切合度。

一种方法以找出适当的词语包括在查询中是比较以前的用户查询使用的语义相似度的计算。

如果存在一个以前的查询,在语义上与当前查询想关联,那么可以建议用户或搜索引擎内部使用修改原始查询。

语义相似度的计算已被用于在语义Web相关的应用,如自动标注网页[7],社区挖掘[23,19],以及实体间关系表示关键字提取[26]。

语义相似度的计算可以用在自然语言处理的各种应用中,如字义消歧[32],语言模型[34],同义词提取[16],叙词表的自动提取[8]。

如手动编制分类器WordNet和大型的文本全集已用于先前有关语义相似度[16,31,13,17]的工作中。

最近,将网络视为一个活生生的主体已经成为一个活跃的研究课题。

一般来说,无监督模式性能在N元计算值从网络上获取比从一个大型的语料库[14,15]中获取的时候要好一些。

雷斯尼克和史密斯[33]从网络中提取双语句子去为机器翻译创建并行语言集。

特尼定义的一个逐点互信息(PMI-IR)的计算,运用搜索引擎由认识到同义词查询结果的数量。

松尾等,人[20]运用类似的方法来衡量词与词之间的相似度和应用图形为基础的聚类算法的词方法。

给定一个分类概念,一个直接的方法来计算两个词(概念)的相似度是找到的最短连接在分类学两个词路径长度[30]。

如果一个词是一词多义则在两个单词之间可能存在多条路径。

在这种情况下,任何含义之间的最短路径都被认为是计算的相似度。

一个是经常使用这种方法依赖在各个环节代表一个统一的距离分类学概念。

雷斯尼克[31]提出一个用信息内容的类似度测量方法。

他把两个概念之间的类似度定义为分类学中的C1和C2共同含有的最大信息内容C。

然后两个词之间的相似度则可用这两个词用到的场合的相似度来定义。

他使用WordNet作为分类系统,用布朗语料库来计算信息内容。

李等人[41]。

结合来自词典分类系统的结构上的语义信息和来自一个非线性模型中的资料集的信息内容。

他们提出了相似的计算,即采用在一个分类系统中最短路径的长度,深度和局域密度。

他们的实验得出了以下结论:

皮尔森相关系数为0.8914基于米勒和查尔斯[24]的基准数据集。

他们没有评估命名实体之间的相似度条件的方法。

林[17]中定义的信息,这些信息以双方共同的概念和每个人的概念中包含的信息是两个概念之间的相似度。

最近,一些关于运用网络信息计算语义相似度的工作正在进行。

松尾等,[19]提出用网络点击率的方法从网络上提取社区。

他们使用重叠(辛普森)系数去计算两个人姓名的联系性,这是由每个人的姓名和他们的联系集(也就是包含这两个名字的查询)的网站点击数来进行计算的。

Sahami等人[36]衡量两种查询的语义相似度通过使用由搜索引擎返回的网页摘要。

对于每个查询,他们从搜索引擎那搜集摘要,并用TF–IDF权值向量来分别表示各个摘要。

每个向量是L2规范化并且向量集合的中心是可以被计算的。

两个查询之间的语义相似度被定义为对应向量集的各中心的乘积。

他们并没有将他们的相似度与基于分类系统相似度计算值进行比较。

陈等人[6]提出了双重检查模式使用由搜索引擎返回的文本摘要来计算词与词之间的语义相似度。

他们从搜索引擎的每个摘要中搜集P和Q这两个词。

然后,他们计算在已经出现Q情况下出现P的次数,以及已经出现P的情况下出现Q的次数。

这些值非线性的组合起来去计算P和Q的相似度。

这种算法严重依赖于搜索引擎的排名算法。

虽然两个词P和Q可能非常相似,但没有理由相信,人们可以在出现Q的摘要上出现P,或者反之。

本论文的实验数据有效地证明着这种观点,很多在数据中相似度为零的词的组合,实际都在MillerandCharles的数据集中。

3.方法

3.1大纲

我们提出一个方法,它结合了返回页总数和摘要来衡量给定的词组之间的语义相似度。

在3.2节,我们使用返回页面计数定义四个相似分数,然后,我们在3.3节我们描述了字典式句法模式提取算法。

我们对那些由我们算法提炼的模式根据它们表现语义相似度的能力来进行排名。

我们使用两个类支持向量机(SVMs)来查找最优的以页面数为基准的相似度得分和排名靠前的最佳组合模式。

SVM被训练为对同义字对和非同义字对分类。

我们选择从WordNet的synsets中选择同义字对(积极训练样本),运用随机扇形选纸法技术来创建非同义字对。

将SVM的输出装换为后验概率。

定义两个词的语义相似度作为后验概率,其中这两个词属于同义词(积极)类。

3.2以页面数为基础的相似分数

查询“P和Q”的返回页计数可以被认为是两个单词(或复杂词组)“P和Q”在网络上出现的近似值。

然而,单独的查询“P和Q”的返回页计数不能准确的表示语义相似度。

比如说,在查询“car”和“automoblie”后google返回的页计数为11300000,然后“car”和“apple”返回的页计数为49000000。

尽管,“automoblie”比“apple”与“car”之间有更大的语义相似度,查询项“car”和“apple”的返回的页计数是“car”和“automoblie”四倍之多。

在评价“P和Q”的相似度的时,不仅要考虑到p和q的返回页计数还要考虑到“P和Q”单独出现的情况。

我们改进四种常用的词汇共同出现率方法:

Jaccard,Overlap(辛普森),Dice,和PMI(逐点互信息)运用页面返回值去计算语义相似度。

在论文的接下来部分,我们用H(p)来表示查询项P在搜索引擎中的页面返回值,两个词(或复杂词组)之间的Webjaccard因素P和Q,Webjaccard(p,q)被定义为:

在那里,P∩Q表示查询项P和Q的结合。

鉴于网络数据规模和噪声,两个词可能会纯属偶然的出现在一个页面上。

为了降低这种由偶然引起的不良影响,如果查询项P∩Q的页面返回值小于一个临界值C5,就将webjaccard因子设为零。

类似的,定义WebOverlap,WebOverlap(P,Q)如下:

WebOverlap是对Overlap(辛普森)因子的一个修改。

定义的WebDice因子是Dice因子的一个变形,WebDice(P,Q)定义如下:

定义的WebPMI是使用页面计数值的PMI的一个变形,

这里,N是文档被搜索引擎建立索引的数量值。

公式4中的概率是根据最大似然原理进行估计的。

运用公式4准备的计算PMI,必须知道被搜索引擎建立索引的文档数量值。

尽管预测被搜索引擎[2]建立索引的文档数量值本身是个有趣的事情,但超过本工作的范围。

在目前的工作中,根据google建立索引页面的数量值设N=

。

3.3从摘要中提取字典式句法模式

3.4结合模式与页面返回值

4.实验

4.1基准数据库

4.2模式选择

4.3语义相似度

4.4基于分类系统的方法

4.5正确率vs摘要值

4.6训练数据

4.7社区挖掘

4.8实体消歧

5.总结

在本论文中,我们提出综合使用页面返回值和摘要来有效地计算两个给定的词或命名实体之间的语义相似度的计算方法。

该方法包含四个基于页面返回值相似度打分以及自动提取字典式句法模式。

综合使用基于页面返回值相似度打分以及运用支持向量机的字典式句法模式。

训练数据运用WordNet同义词集自动生成。

提出的计算方法优于现有的所有方法,包括先前提出的以基准数据集为基础地并基于Web的语义相似度的方法。

为这个评测基准数据集上的语义相似度而建立的一种与人为设定的等级的高度相关性(相关系数为0.834)。

只有1900和2400个正反面例子对提出的计算方法是有用,这是非常有效并且可扩展的,因为它仅用了google中排名靠前的摘要。

与基于WordNet语义相似度计算鲜明的特点是新的方法是不需要分类的,如WordNet对相似度的计算。

因此,该方法可应用于不存在分类系统或者不需要实时更新分类系统的大量工作中。

采用该方法进行了社区挖掘和实体消歧的实验中,实验的结果表明该方法可获取命名实体的语义相似度。

在今后的研究中,我们打算在自动代名词提取,查询建议和别名识别中运用该方法。

6.参考文献

[1]A.BaggaandB.Baldwin.Entity-basedcrossdocumentcoreferencingusingthevectorspacemodel.InProc.of36thCOLING-ACL,pages79{85,1998.

[2]Z.Bar-YossefandM.Gurevich.Randomsamplingfromasearchengine'sindex.InProceedingsof15thInternationalWorldWideWebConference,2006.

[3]R.BekkermanandA.McCallum.Disambiguatingwebappearancesofpeopleinasocialnetwork.InProceedingsoftheWorldWideWebConference(WWW),pages463{470,2005.

[4]D.Bollegala,Y.Matsuo,andM.Ishizuka.Disambiguatingpersonalnamesonthewebusing

automaticallyextractedkeyphrases.InProc.ofthe17thEuropeanConferenceonArtificialIntelligence,pages553{557,2006.

[5]C.Buckley,G.Salton,J.Allan,andA.Singhal.Automaticqueryexpansionusingsmart:

Trec3.InProc.of3rdTextREtreivalConference,pages69{80,1994.

[6]H.Chen,M.Lin,andY.Wei.Novelassociationmeasuresusingwebsearchwithdoublechecking.InProc.oftheCOLING/ACL2006,pages1009{1016,2006.2006.

[7]P.Cimano,S.Handschuh,andS.Staab.Towardstheself-annotatingweb.InProc.of13thWWW,2004.

[8]J.Curran.Ensemblementhodsforautomaticthesaurusextraction.InProc.ofEMNLP,2002.

[9]D.R.Cutting,J.O.Pedersen,D.Karger,andJ.W.Tukey.Scatter/gather:

Acluster-basedapproachtobrowsinglargedocumentcollections.InProceedingsSIGIR'92,pages318{329,1992.

[10]M.FleischmanandE.Hovy.Multi-documentpersonnameresolution.InProceedingsof42ndAnnualMeetingoftheAssociationforComputationalLinguistics(ACL),ReferenceResolutionWorkshop,2004.

[11]H.Han,H.Zha,andC.L.Giles.Namedisambiguationinauthorcitationsusingak-wayspectralclusteringmethod.InProceedingsoftheInternationalConferenceonDigitalLibraries,2005.

[12]M.Hearst.Automaticacquisitionofhyponymsfromlargetextcorpora.InProc.of14thCOLING,pages539{545,1992.

[13]J.JiangandD.Conrath.Semanticsimilaritybasedoncorpusstatisticsandlexicaltaxonomy.InProc.oftheInternationalConferenceonResearchinComputationalLinguisticsROCLINGX,1998.

[14]F.KellerandM.Lapata.Usingthewebtoobtainfrequenciesforunseenbigrams.ComputationalLinguistics,29(3):

459{484,2003.

[15]M.LapataandF.Keller.Web-basedmodelsofrnaturallanguageprocessing.ACMTransactionsonSpeechandLanguageProcessing,2

(1):

1{31,2005.

[16]D.Lin.Automaticretreivalandclusteringofsimilarwords.InProc.ofthe17thCOLING,pages768{774,1998.

[17]D.Lin.Aninformation-theoreticde¯nitionofsimilarity.InProc.ofthe15thICML,pages296{304,1998.

[18]C.D.ManningandH.SchÄutze.FoundationsofStatisticalNaturalLanguageProcessing.TheMITPress,Cambridge,Massachusetts,2002.

[19]Y.Matsuo,J.Mori,M.Hamasaki,K.Ishida,T.Nishimura,H.Takeda,K.Hasida,andM.Ishizuka.Polyphonet:

Anadvancedsocialnetworkextractionsystem.InProc.of15thInternationalWorldWideWebConference,2006.

[20]Y.Matsuo,T.Sakaki,K.Uchiyama,andM.Ishizuka.Graph-basedwordclusteringusingwebsearchengine.InProc.ofEMNLP2006,2006.

[21]D.McCarthy,R.Koeling,J.Weeds,andJ.Carroll.Findingpredominantwordsensesinuntaggedtext.InProceedingsofthe42ndMeetingoftheAssociationforComputationalLinguistics(ACL'04),pages279{286,2004.

[22]D.Medin,R.Goldstone,andD.Gentner.Respectsforsimilarity.PsychologicalReview,6

(1):

1{28,1991.

[23]P.Mika.Ontologiesareus:

Aunifiedmodelofsocialnetworksandsemantics.InProc.ofISWC2005,2005.

[24]G.MillerandW.Charles.Contextualcorrelatesofsemanticsimilarity.LanguageandCognitiveProcesses,6

(1):

1{28,1998.

[25]M.Mitra,A.Singhal,andC.Buckley.Improvingautomaticqueryexpansion.InProc.of21stAnnualInternationalACM-SIGIRConferenceonResearchandDevelopmentinInformationRetrieval,pages206{214,1998.

[26]J.Mori,Y.Matsuo,andM.Ishizuka.Extracti

- 配套讲稿:

如PPT文件的首页显示word图标,表示该PPT已包含配套word讲稿。双击word图标可打开word文档。

- 特殊限制:

部分文档作品中含有的国旗、国徽等图片,仅作为作品整体效果示例展示,禁止商用。设计者仅对作品中独创性部分享有著作权。

- 关 键 词:

- 翻译

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

《C12343098汽轮机操作规程》要点.docx

《C12343098汽轮机操作规程》要点.docx