hadoop20详细安装文档.docx

hadoop20详细安装文档.docx

- 文档编号:24444619

- 上传时间:2023-05-27

- 格式:DOCX

- 页数:31

- 大小:2.29MB

hadoop20详细安装文档.docx

《hadoop20详细安装文档.docx》由会员分享,可在线阅读,更多相关《hadoop20详细安装文档.docx(31页珍藏版)》请在冰豆网上搜索。

hadoop20详细安装文档

Hadoop2.0安装文档

实际上hadoop2.0的搭建与hadoop1.0的很多类同,有些步骤我没有过多的写的比较详细,但是可以参考我写的hadoop1.0以及linux的安装教程文档(也在笔记中,需要的话请仔细找下!

)

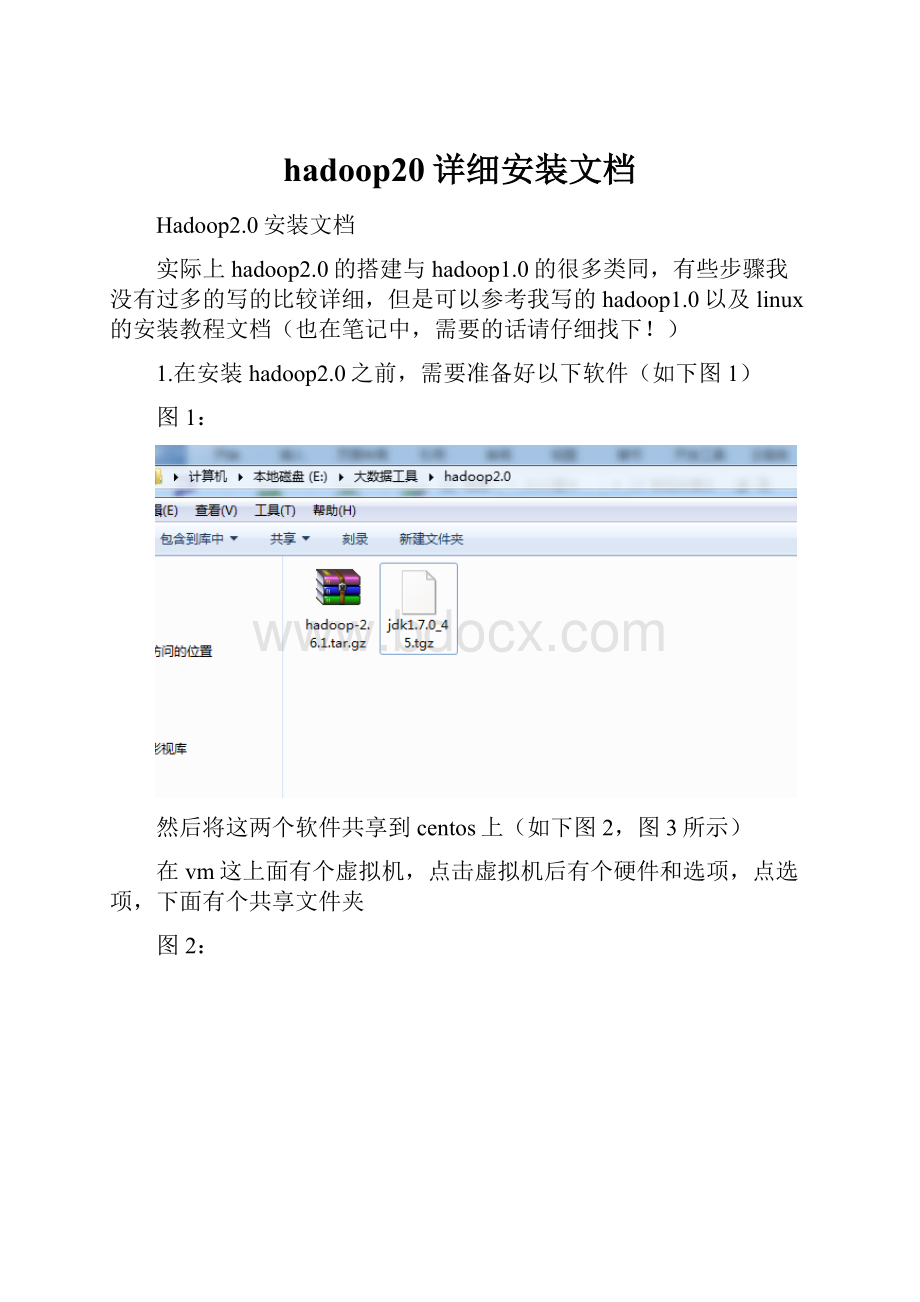

1.在安装hadoop2.0之前,需要准备好以下软件(如下图1)

图1:

然后将这两个软件共享到centos上(如下图2,图3所示)

在vm这上面有个虚拟机,点击虚拟机后有个硬件和选项,点选项,下面有个共享文件夹

图2:

图3:

然后为了有个集群的概念,我们把一台linux机器复制成有三份!

如下图4所示:

注:

在复制前,必须要把linux的机器要在关机或者挂起状态,否则数据可能会丢失。

图4:

然后打开这三个虚拟镜像并且启动三个镜像(如下图5所示)

如果出现说:

此虚拟机可能已被移动或复制,那你点击:

我已复制该虚拟机

图5:

然后命令行输入:

su//进入管理员模式

然后命令行再输入:

cd/etc/sysconfig/network-scripts/ifcfg-eth0

然后将三个虚拟机的其中两个虚拟机的ip更改,因为三个虚拟机的ip不能都一样。

如下图5,6,7,8的图:

master图6:

Slave1图7:

Slave2图8:

然后打开secureCRT远程控制软件连接三台虚拟机(如下图8)

图9:

1.我们开始配置本地网络配置(修改hosts文件)

命令行输入:

vim/etc/hosts

然后在hosts这个文件里面把主节点的ip地址写入进去

192.168.183.10master

192.168.183.11slave1

192.168.183.12slave2

然后保存退出

但是host还没有生效,需要生效

在命令行输入:

hostnamemaster

然后再输入:

hostname查看

但是这个生效只是临时生效,我们需要改为永久生效:

在命令行输入:

vim/etc/sysconfig/network

然后原先network里面的是:

HOSTNAME=localhost

我们改为:

HOSTNAME=master//其他节点也是一样这么操作,这里就不演示了

建立每台机器的互信关系(这样方便我们日后一台机器对另外一台机器的操作)

重点:

是每个机器都要输入:

ssh-keygen

在命令行输入:

ssh-keygen然后回车然后回车,回车(回三次车)。

(如下图10所示)

然后再输入:

ssh-keygen然后有个选项让你选择yes/no的,你选择yes,因为直到有个yes/no的选项出现你才能正式的互信。

图10:

然后进入隐藏目录

在命令行输入:

cd~/.ssh/然后ls(如下图11)

图11:

Id_rsa.pub是共钥文件,id_rsa是密钥文件

我们要对id_rsa.pub这个公钥文件的内容拷贝给authorized_keys这个文件(在此说明:

如果没有authorized_keys这个文件,请自己创建!

!

)

创建文件的命令:

touchauthorized_keys(如下图12所示)

图12:

我们看一下id_rsa.pub这个公钥文件的内容

输入命令行:

catid_rsa.pub看看这公钥

然后把slave1的公钥复制到主机节点master的authorized_keys上

在master命令行输入:

vimauthorized_keys

然后接下来把然后把slave1的公钥复制到authorized_keys这里(如下图13,14,15)

图13:

图14:

图15:

把三个机器的公钥密码全部放入master的authorized_keys文件中

然后下一步操作就是把主节点上的authorized_keys分别复制给slave1和slave2这两个节点上(这是我的ip,你们要复制下面的命令行的时候请先把自个的机器ip修改上去)

命令行输入:

scp-rpauthorized_keys192.168.183.20:

~/.ssh/

命令行输入:

scp-rpauthorized_keys192.168.183.13:

~/.ssh/(如下图16)

图16:

然后分别给slave1和slave2检查一下是否有主节点传过来的公钥文件

在slave1和slave2的命令行上分别输入:

catauthorized_keys

然后我们就可以给三台机器互相登录而且不需要密码了

那么我们试一下:

在主节点上命令行上输入:

ssh192.168.183.20如果要退出的话就是输入:

exit

然后我们在主机节点上登录子节点:

ssh192.168.183.13如果要退出的话就是输入:

exit

然后在master里面输入:

cd/mnt/hdfs//查看在linux下共享的文件(如下图17)

图17:

看到了把?

你共享的文件就已经在linux上有了。

然后我们把jdk和hadoop2.0工具包放入linux下的/usr/local/src/下(如下图18所示)

命令行输入:

cphadoop-2.6.1.tar.gz/usr/local/src/

命令行输入:

cpjdk1.7.0_45.tgz/usr/local/src/

然后去/usr/local/src/下去查看有没有拷贝过来的文件

图18:

然后解压hadoop2.0以及jdk7的文件(如下图19所示)

命令行输入:

tarxvzfhadoop-2.6.1.tar.gz

命令行输入:

tarxvzfjdk1.7.0_45.tgz

图19:

然后进入jdk,命令行输入:

cdjdk1.7.0_45/

然后查看当前的一个目录路径,命令行输入:

pwd

然后将改路径写入配置文件当中,命令行输入:

vim~/.bashrc(如下图20所示)

图20:

复制我这个配置命令:

exportJAVA_HOME=/usr/local/src/jdk1.7.0_45(如下图21)

然后再配置CLASSPATH,复制配置命令:

exportCLASSPATH=.:

$CLASSPATH:

$JAVA_HOME/lib

然后再配置path,复制配置命令:

exportPATH=$JAVA_HOME/bin:

$JRE_HOME/bin:

$PATH

图21:

然后退出该修改界面(退出界面请先按Esc键,然后点Shift键加分号;键然后输入wq然后再按Enter键退出)

然后在命令行输入:

source~/.bashrc重置一下

然后我们直接执行java,在命令行直接输入:

java然后这个java已经被系统自动识别了,然后我们看看java这个位置在哪里,命令行输入:

whichjava(如下图22所示)

图22:

2.那么接下来我们也要把剩下两个节点也要安装java环境

在主节点输入:

cd/usr/local/src/

再输入:

ls

然后将java包复制一份到slave1和slave2这两个节点上去

在主节点输入:

scp-rpjdk1.7.0_45slave1:

/usr/local/src/

在主节点输入:

scp-rpjdk1.7.0_45slave2:

/usr/local/src/

然后让你输入yes/no你输入yes,然后让你输入密码,你输入你创建这台机器的密码,然后即可完成远程复制!

!

(如下图23所示)

图23:

然后我们再分别切到slave1和slave2这两个节点查看是否将jdk文件发送了过来

在slave1机器上输入:

cd/usr/local/src/

然后再输入:

ls进行查看是否有jdk文件(如下图24,25)

图24:

图25:

然后再分别给slave1和slave2配置环境变量。

操作跟上面给主节点master配置环境变量一样,输入:

vim~/.bashrc把exportJAVA_HOME=/usr/local/src/jdk1.7.0_45和exportCLASSPATH=.:

$CLASSPATH:

$JAVA_HOME/lib和exportPATH=$PATH:

$JAVA_HOME/bin

写在bashrc下

然后退出该修改界面(退出界面请先按Esc键,然后点Shift键加分号键然后输入wq然后再按Enter键退出)

然后在命令行输入:

source~/.bashrc重置一下

然后我们直接执行java,在命令行直接输入:

java然后这个java已经被系统自动识别了

然后我们看看java这个位置在哪里,命令行输入:

whichjava(如下图26,27所示)

图26:

图27:

然后我们开始准备搭建hadoop2.0集群,在此之前需要把ssh配置好(如下操作与图17所示)

在此之前我们需要先把防火墙关闭了,以免防火墙的启动会导致我们集群启动失败

闭防火墙(在三台机器上或者更多的机器上执行一下命令)

在命令行输入:

/etc/init.d/iptables stop(如下图28所示)

然后检查一下是否关闭成功:

在每台机命令行输入:

chkconfig--level35iptablesoff

然后再从命令行输入:

getenforce查看是否关闭了(在每台机器都输入此命令)

图28:

然后我们打开hadoop2.0安装包(如下图29所示)

图29:

然后在hadoop-2.6.1这个目录下创建一个tmp目录,用来存放之后的一些临时文件

命令行输入:

mkdirtmp

然后进入hadoop-2.6.1的etc文件里的hadoop文件(如下图30)

图30:

然后修改hadoop文件夹里面的hadoop-env.sh这个文件

命令行输入:

vimhadoop-env.sh

在hadoop-env.sh这个文件里面配置jdk路径(如下图31所示)

图31:

第二步修改yarn-env.sh文件

命令行输入:

vimyarn-env.sh然后在这个文件找到相应被注释的exportJAVA_HOME=,将它取消注释并把jdk路径继续填充上去(如下图32所示)

图32:

然后继续修改,修改一个slaves文件(如下图33所示)

修改文件:

vimslaves

在slaves里面填充slave1slave2

图33:

然后修改core-site.xml这个文件

在configuration里面添加数据(如下图34所示)

图34:

然后再修改hdfs-site.xml这个文件(如下图35,图36所示)

首先先在hadoop-2.6.1目录下创建dfs文件,然后在dfs文件里面再创建name和data这两个文件

添加内容:

9001

/usr/local/src/hadoop-2.6.1/dfs/name

/usr/local/src/hadoop-2.6.1/dfs/data

图35:

图36:

然后在hadoop根目录下有一个文件mapred-site.xml.template模版,你需要将其拷贝一份并且改名为mapred-site.xml。

(如下图37,图38所示)

命令行输入:

cpmapred-site.xml.templatemapred-site.xml

然后修改mapred-site.xml这个文件:

vimmapred-site.xml

图37:

图38:

然后再修改yarn-site.xml这个文件

命令行输入:

vimyarn-site.xml添加内容(如下图39)

图39:

然后接下来把这个配置好的hadoop2.0安装文件分发到各个子节点上(如下图40所示)

分发完以后在子节点上的/usr/lcoal/src目录下查看有没有hadoop2.0文件

图40:

然后现在所有配置配置完毕,我们来准备启动:

(如下图41所示)

在启动之前必须先格式化hadoop,必须要先hadoop下的bin目录下进行格式化

命令行输入:

hadoopnamenode-formate(如下图41所示)

图41:

在hadoop-2.6.1的根目录下启动:

(如下图42所示)

命令行输入:

./sbin/start-all.sh

主节点成功启动图42:

子节点成功启动图43:

子节点成功启动44:

恭喜,搭建完成!

!

- 配套讲稿:

如PPT文件的首页显示word图标,表示该PPT已包含配套word讲稿。双击word图标可打开word文档。

- 特殊限制:

部分文档作品中含有的国旗、国徽等图片,仅作为作品整体效果示例展示,禁止商用。设计者仅对作品中独创性部分享有著作权。

- 关 键 词:

- hadoop20 详细 安装 文档

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

《当代世界政治与经济》.docx

《当代世界政治与经济》.docx