hadoop安装是否成功验证Word文件下载.docx

hadoop安装是否成功验证Word文件下载.docx

- 文档编号:22378471

- 上传时间:2023-02-03

- 格式:DOCX

- 页数:13

- 大小:554.42KB

hadoop安装是否成功验证Word文件下载.docx

《hadoop安装是否成功验证Word文件下载.docx》由会员分享,可在线阅读,更多相关《hadoop安装是否成功验证Word文件下载.docx(13页珍藏版)》请在冰豆网上搜索。

常见问题FAQ6.2"

进行解决,如果是"

Noroutetohost"

问题,采用"

常见问题FAQ6.3"

进行解决。

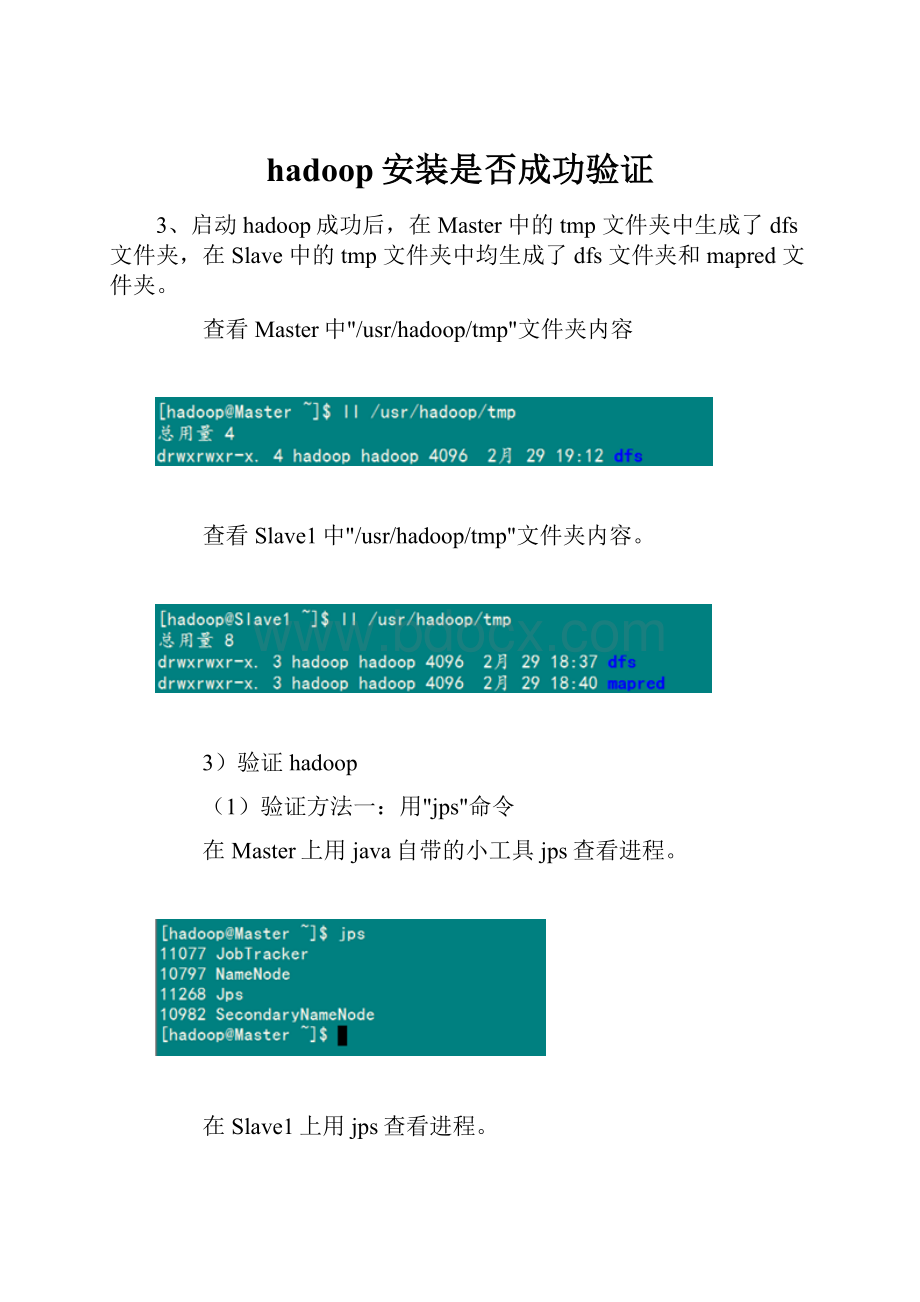

(2)验证方式二:

hadoopdfsadmin-report"

用这个命令可以查看Hadoop集群的状态。

Master服务器的状态:

Slave服务器的状态

4.4网页查看集群

1)访问"

http:

192.168.1.2:

50030"

2)访问"

50070"

5、常见问题FAQ

5.1关于Warning:

$HADOOP_HOMEisdeprecated.

hadoop1.0.0版本,安装完之后敲入hadoop命令时,老是提示这个警告:

Warning:

经查hadoop-1.0.0/bin/hadoop脚本和"

hadoop-config.sh"

脚本,发现脚本中对HADOOP_HOME的环境变量设置做了判断,笔者的环境根本不需要设置HADOOP_HOME环境变量。

解决方案一:

编辑"

/etc/profile"

文件,去掉HADOOP_HOME的变量设定,重新输入hadoopfs命令,警告消失。

解决方案二:

文件,添加一个环境变量,之后警告消失:

exportHADOOP_HOME_WARN_SUPPRESS=1

解决方案三:

文件,把下面的"

if-fi"

功能注释掉。

我们这里本着不动Hadoop原配置文件的前提下,采用"

方案二"

,在"

文件添加上面内容,并用命令"

source/etc/profile"

使之有效。

1)切换至root用户

2)添加内容

3)重新生效

5.2解决"

nodatanodetostop"

问题

当我停止Hadoop时发现如下信息:

原因:

每次namenodeformat会重新创建一个namenodeId,而tmp/dfs/data下包含了上次format下的id,namenodeformat清空了namenode下的数据,但是没有清空datanode下的数据,导致启动时失败,所要做的就是每次fotmat前,清空tmp一下的所有目录。

第一种解决方案如下:

1)先删除"

rm-rf/usr/hadoop/tmp

2)创建"

文件夹

mkdir/usr/hadoop/tmp

3)删除"

/tmp"

下以"

hadoop"

开头文件

rm-rf/tmp/hadoop*

4)重新格式化hadoop

hadoopnamenode-format

5)启动hadoop

start-all.sh

使用第一种方案,有种不好处就是原来集群上的重要数据全没有了。

假如说Hadoop集群已经运行了一段时间。

建议采用第二种。

第二种方案如下:

1)修改每个Slave的namespaceID使其与Master的namespaceID一致。

或者

2)修改Master的namespaceID使其与Slave的namespaceID一致。

该"

位于"

/usr/hadoop/tmp/dfs/data/current/VERSION"

文件中,前面蓝色的可能根据实际情况变化,但后面红色是不变的。

例如:

查看"

Master"

下的"

VERSION"

文件

本人建议采用第二种,这样方便快捷,而且还能防止误删。

5.3Slave服务器中datanode启动后又自动关闭

查看日志发下如下错误。

ERROR

org.apache.hadoop.hdfs.server.datanode.DataNode:

java.io.IOException:

Callto...failedonlocalexception:

.NoRouteToHostException:

Noroutetohost

解决方案是:

关闭防火墙

serviceiptablesstop

5.4从本地往hdfs文件系统上传文件

出现如下错误:

INFOhdfs.DFSClient:

ExceptionincreateBlockOutputStreamjava.io.IOException:

BadconnectackwithfirstBadLink

Abandoningblockblk_-130********03292651_37023

WARNhdfs.DFSClient:

DataStreamerException:

Unabletocreatenewblock.

1)关闭防火墙

2)禁用selinux

编辑"

/etc/selinux/config"

文件,设置"

SELINUX=disabled"

5.5安全模式导致的错误

org.apache.hadoop.dfs.SafeModeException:

Cannotdelete...,Namenodeisinsafemode

在分布式文件系统启动的时候,开始的时候会有安全模式,当分布式文件系统处于安全模式的情况下,文件系统中的内容不允许修改也不允许删除,直到安全模式结束。

安全模式主要是为了系统启动的时候检查各个DataNode上数据块的有效性,同时根据策略必要的复制或者删除部分数据块。

运行期通过命令也可以进入安全模式。

在实践过程中,系统启动的时候去修改和删除文件也会有安全模式不允许修改的出错提示,只需要等待一会儿即可。

关闭安全模式

hadoopdfsadmin-safemodeleave

5.6解决ExceededMAX_FAILED_UNIQUE_FETCHES

出现错误如下:

ShuffleError:

ExceededMAX_FAILED_UNIQUE_FETCHES;

bailing-out

程序里面需要打开多个文件,进行分析,系统一般默认数量是1024,(用ulimit-a可以看到)对于正常使用是够了,但是对于程序来讲,就太少了。

修改2个文件。

1)"

/etc/security/limits.conf"

vim/etc/security/limits.conf

加上:

softnofile102400

hardnofile409600

2)"

/etc/pam.d/login"

vim/etc/pam.d/login

添加:

sessionrequired/lib/security/pam_limits.so

针对第一个问题我纠正下答案:

这是reduce预处理阶段shuffle时获取已完成的map的输出失败次数超过上限造成的,上限默认为5。

引起此问题的方式可能会有很多种,比如网络连接不正常,连接超时,带宽较差以及端口阻塞等。

通常框架内网络情况较好是不会出现此错误的。

5.7解决"

Toomanyfetch-failures"

出现这个问题主要是结点间的连通不够全面。

1)检查"

/etc/hosts"

要求本机ip对应服务器名

要求要包含所有的服务器ip+服务器名

2)检查"

.ssh/authorized_keys"

要求包含所有服务器(包括其自身)的publickey

5.8处理速度特别的慢

出现map很快,但是reduce很慢,而且反复出现"

reduce=0%"

。

解决方案如下:

结合解决方案5.7,然后修改"

conf/hadoop-env.sh"

中的"

exportHADOOP_HEAPSIZE=4000"

5.9解决hadoopOutOfMemoryError问题

出现这种异常,明显是jvm内存不够得原因。

要修改所有的datanode的jvm内存大小。

Java–Xms1024m-Xmx4096m

一般jvm的最大内存使用应该为总内存大小的一半,我们使用的8G内存,所以设置为4096m,这一值可能依旧不是最优的值。

5.10Namenodeinsafemode

bin/hadoopdfsadmin-safemodeleave

5.11IO写操作出现问题

0-1246359584298,infoPort=50075,ipcPort=50020):

Gotexceptionwhileservingblk_-5911099437886836280_1292to/172.16.100.165:

.SocketTimeoutException:

480000millistimeoutwhilewaitingforchanneltobereadyforwrite.ch:

java.nio.channels.SocketChannel[connectedlocal=/

172.16.100.165:

50010remote=/172.16.100.165:

50930]

at.SocketIOWithTimeout.waitForIO(SocketIOWithTimeout.java:

185)

at.SocketOutputStream.waitForWritable(SocketOutputStream.java:

159)

……

Itseemstherearemanyreasonsthatitcantimeout,theexamplegiveninHADOOP-3831isaslowreadingclient.

解决方案如下:

在hadoop-site.xml中设置dfs.datanode.socket.write.timeout=0

5.12statusof255error

错误类型:

java.io.IOException:

Taskprocessexitwithnonzerostatusof255.

atorg.apache.hadoop.mapred.TaskRunner.run(TaskRunner.java:

424)

错误原因:

Setmapred.jobtracker.retirejob.intervalandmapred.userlog.retain.hourstohighervalue.Bydefault,theirvaluesare24hours.Thesemightbethereasonforfailure,thoughI'

mnotsurerestart.

单个datanode

如果一个datanode出现问题,解决之后需要重新加入cluster而不重启cluster,方法如下:

bin/hadoop-daemon.shstartdatanode

bin/hadoop-daemon.shstartjobtracker

- 配套讲稿:

如PPT文件的首页显示word图标,表示该PPT已包含配套word讲稿。双击word图标可打开word文档。

- 特殊限制:

部分文档作品中含有的国旗、国徽等图片,仅作为作品整体效果示例展示,禁止商用。设计者仅对作品中独创性部分享有著作权。

- 关 键 词:

- hadoop 安装 是否 成功 验证

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

1212中级汽车维修工考试试题三.docx

1212中级汽车维修工考试试题三.docx