语音识别论文中期报告文档格式.docx

语音识别论文中期报告文档格式.docx

- 文档编号:18059279

- 上传时间:2022-12-13

- 格式:DOCX

- 页数:17

- 大小:376.85KB

语音识别论文中期报告文档格式.docx

《语音识别论文中期报告文档格式.docx》由会员分享,可在线阅读,更多相关《语音识别论文中期报告文档格式.docx(17页珍藏版)》请在冰豆网上搜索。

(9)利用客观评价准则来评定本文所设计说话人识别系统的性能,并将此系统与传统的说话人识别系统进行性能比较。

(10)总结该设计的优点与不足。

二、研究工作进展(开题以来已完成的工作和取得的成果以及存在的问题)

(一)已完成的工作

本设计全程以matlab进行实验和仿真

1、以本课题组10名说话人为实验对象,采集样本语音信号。

实验中,采样频率为8kHz,利用笔记本电脑内置的麦克风采集10名说话人(说话人1、说话人2、,、说话人10)的语音信号,每人录音1200次,每次1s,匀速朗读书本任意内容,其中1000次用于训练生成码本,200次用于识别。

在matlab中实现该功能的主要语句:

y=wavrecord(1*fs,fs,1,'

int16'

),1*fs表示采样时间为1s。

fs代表采样频率,本实验中fs=8000Hz。

1代表单声道。

int16表示采集的数据为双精度。

采集

的语音信号保存在变量y中。

然后利用函数wavwrite(y,fs,'

D:

\xufeng\work\xufeng_1.wav'

)将采集的语音信号

保存在D盘相应的位置,文件的名称为xufeng_1.wav。

图2显示了采集的语音"

语音信号处理”和"

为毕

业奋斗”在时域的波形图

图2采集的语音“语音信号处理”和“为毕业奋斗”在时域的波形图

2、对样本语音信号进行高通滤波,端点检测,加窗分帧等预处理操作。

对于每人的1000个用于训练的语音信号样本,首先经过高通滤波器(下限截止频率fL=1kHz),滤除

低频干扰,其次利用汉明窗进行分帧处理,将非平稳信号转换为短时平稳信号,帧长取25.6ms,帧移取8ms。

最后采用基于短时能量和短时过零率的端点检测法找到信号的有声段,选取其中的100帧有声段。

在matlab

中实现该功能的步骤

(1)高通滤波器:

为消除低频干扰需采用高通数字滤波器对语音信号进行滤波,如图3显示了标准语

音库中的语音信号经过高通滤波器后时域和频域的变化。

图4显示了“语音信号处理”和“为毕业奋斗”

在经过高通滤波后的时域波形图

20

10

-10

-20

-30

-40

01000200030004000

频率

图3标准语音库中的信号经过高通滤波后的时域与频域对比

0.5

0.4

0.3

0.2

0.1

-0.1

-0.2

-0.3

-0.4

-0.5

图4“语音信号处理”和“为毕业奋斗”在经过高通滤波后的时域波形图

(2)加窗分帧:

本文的系统采用“短时分析技术”对时变语音信号进行处理。

根据对语音信号的分析可知,其特性是随时间而变化的,是一个非稳态过程,虽然语音信号具有时变性,但声音是由人的口腔肌肉运动构成声道的某种形状而产生的响应,而肌肉运动频率相对于语音频率来讲相对缓慢得多,在一个短时间片内,其基本特性保持相对稳定。

所以,可将其看作是一个准稳态过程。

将语音信号分成连续的小段进行分析,其中每一段称为一帧。

常用的窗函数有:

矩形窗、汉明窗。

对语音信号的时域分析来说,窗函数的形状非常重要,矩形窗的谱平滑性较好,但波形细节丢失,并且矩形窗可能产生泄露现象;

而汉明窗可以有效地克服泄露现象,其的应用范围非常广泛。

另外窗口的长度N对于能否反映语音信号的幅度变化,将起决定作用。

窗长越长,

8kHz

它对信号的平均和平滑作用便越厉害。

要想反映快速时变的信息,窗长应该取得短一些。

通常认为在

F,N折衷选择为80~300(即8~30ms持续时间)。

分帧操作通常有两种方式:

连续分帧,交叠分

帧,后者分帧中的交叠部分称为帧移。

由于语音是连续的信号,交叠式分帧可以保证各个语音帧之间平滑

5所示。

,所以本文采用汉明窗交叠分帧的方案。

交叠式分帧的示意图如图

第k+1帧

帧移

图5交叠式分帧的示意图

Matlab中的汉明窗交叠分帧的语句为:

enframe(y,256,80)其中y为输入语音信号,窗长长取25.6ms,帧

8ms。

图4显示了语音信号加窗分帧之后的效果。

(静音段)。

具体可以描述为从众多

图6语音“语音信号处理”和“为毕业奋斗”在加窗分帧后的效果图

(3)端点检测:

从采样得到的数字信号中判断出语音段和非语音段

,为语音信号的特征提取工作锁定有价值的目标数据。

端点检测过

可:

基于双门限方法、基于倒谱特征方法、基于信息嫡方法、基于能频值方法等。

对于

语音段和静音段的区分,较为常用的是过零率和短时能量相结合的方法,该方法的优点是复杂度较低,适用于本识别系统。

图7显示了语音信号进行端点检测后的效果图。

图7语音“语音信号处理”和“为毕业奋斗”在进行端点检测后的效果图

如此我们可将静音段全部去掉只保留有声段语音信号,有效减少了系统运算量,降低了系统的时间开

销,提高了系统效率。

3、讨论语音信号特征参数的选取问题。

在己有的说话人识别系统中,应用最为广泛的识别特征为:

根据声道模型所提出的线性预测倒谱系数

_PCC、根据临界带所提出的Mel频域倒谱系数MFCC等。

但在实际应用中,LPCC对辅音的描述能力差强人意,而且抗噪性能较差,因此本文采取另外一种特征参数MFCC,它比LPCC参数具有更高的抗噪性能

且不需要假设语音信号为自回归信号适用的范围更广。

美尔倒谱参数(Melfrequencycepstrumcoefficient,MFCC)是基于人耳的听觉特性,把时域频谱转换成基于Mel频标的非线性频谱,最后转换到倒谱域上。

在没有任何假设前提的情况下充分考虑了人的听觉特性,所以MFCC参数具有较好的识别能力和抗噪特性,但需要大量的的计算量和比较高的计算精度。

MFCC

不同于LPCC。

语音识别中MFCC参数的性能明显得优于了LPCC参数。

MFCC参数是通过Mel频标上等

带宽的滤波器组方法计算得到的。

大约1000Hz以上的声音频率范围内,人类的感知在对数频率坐标上遵循

近似线性关系,在时域内不遵循线性关系。

4、提取预处理后的语音信号中的特征参数。

MFCC参数的计算过程如图7所示。

图8MFCC计算过程图解

具体过程如下:

1经过预处理后,语音信号变成了短时平稳信号,用N=256点的FFT变换将每一帧的时域信号X(n)转

化成频域信号X(w),并计算各帧的短时能量谱|X(w)|2。

2由于X(w)对应的fHz,为了提取MFCC需将fHz转化到fmel频率上来,本文中普通频率转换成美尔频

率的转化公式:

fmel=25951nU+Q/700)

3在美尔频域(fmel)内将三角带通滤波器组加于美尔坐标,得到了滤波器组的系统函数,第m个滤波

器的系统函数表示为Hm(w),本文中美尔滤波器组包含滤波器24个。

如图8所示两种美尔频率下的滤波器

组的频带排列方式。

然后计算美尔坐标上的能量谱|X(w)|2经过此滤波器取对数后的输出,即:

2

第m个滤波器的输出:

P(m)=ln[£

|X(w)|Hm(w]m=1,2,3,…M

其中瓦|X(w)|Hm(w)表示一个语音样本经过分帧以后所有帧经过第m个滤波器后的输出,因为本文

采用24个美尔滤波器,所以m最大值M=24。

4

最后美尔倒谱c(k)可用DCT变换求得,公式为:

其中K代表MFCC的阶数,K通常取12~24之间的数值,而且一般舍弃第0(k=0)阶倒谱系数因为它

反映的是频谱能量。

根据文献[31]~[33]的工作本文选取c(5)~c(16)总共12阶的倒谱参数,即k=5,6,7,…,16。

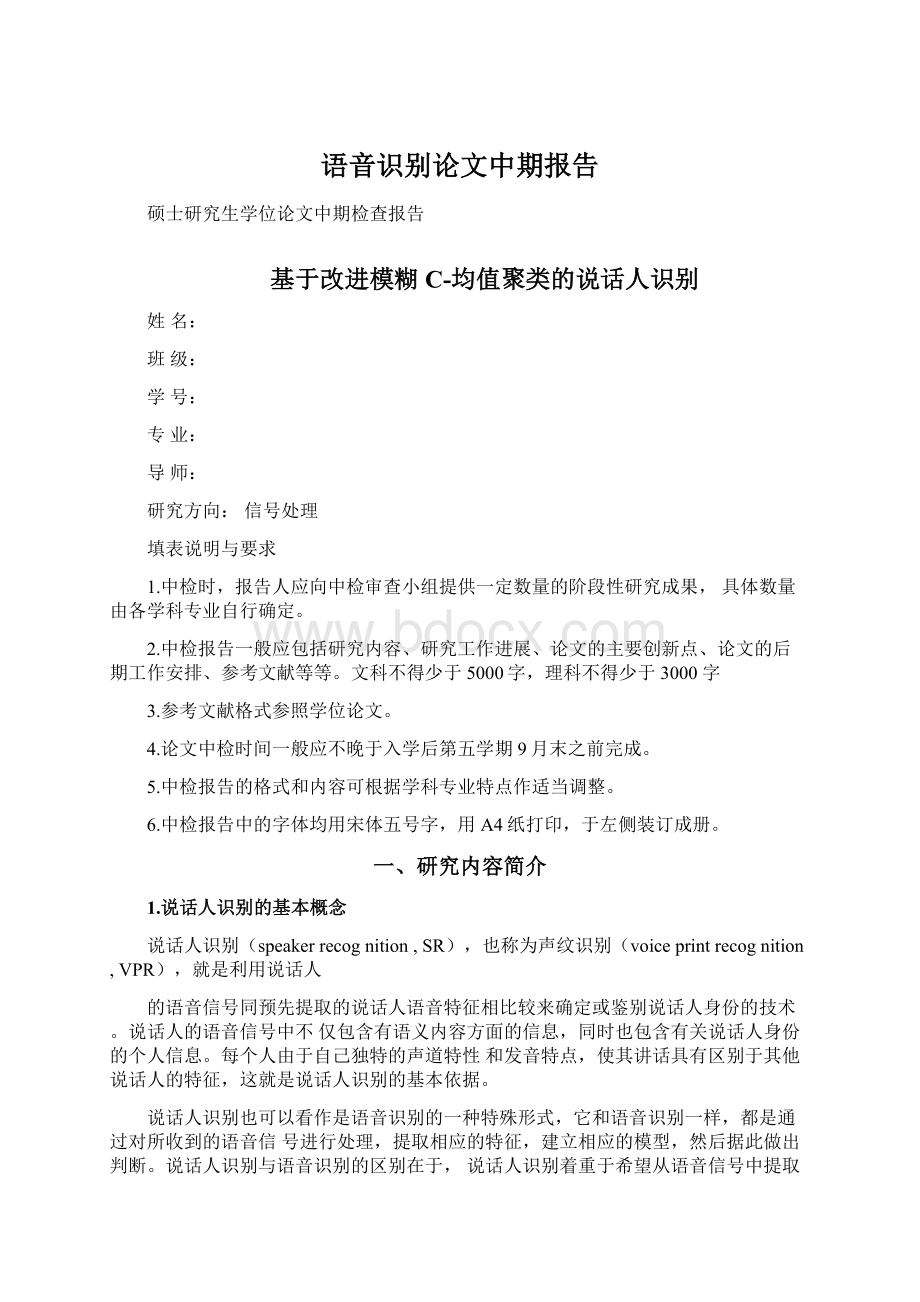

图9显示了语音样本“语音信号处理”的前20帧的c(5)~c(16)12阶的倒谱参数(1s的语音信号分为97帧)。

VariableEditor-m

Staci?

B^se▼

恥validplotsfonm厲!

_)T

田m<

97x12double*

1

3

5

7

11

12

■12.^44E

-1&

5O5

11626

-1.577S*

<

1,3217

6419

-4.4^6

■3.534e

0.5345

・0.6305

42,0424

^.9794

-5,0073

■1-7770

^.9217

^1.7&

51

・L2035

4-7790

4.44^1

0,0807

・1.1193

■0^9&

6

g

43.7615

・3.1301

-2-44&

-0.6150

0^221

0.5741

4.1177

・L5155

0^719

-15.5745

-3.3396

5.2522

-1^599

-3.917^

-1.0&

41

.173&

13396

1.7170

-0.60S.2

-M924

-O.02SB

-1^.6753:

-3.7757

-4.6545

0.1693

13258

2.7155

Z3687

14773

-O.to67

・1.5514

-0.M88

-0.185B

-5.3172

-2.W27

-0.5-926

0.3&

21

0L1543

-0ul711

-1.1413

03326

•CkMlLl.

-13.4B71

倔站

-2.8437

-2J134

-aefisi

-0.1035

-1.6S73

・0.6551

-0„6263

■茎54鈔

-i3754

1.7126

2.3245

-JJM22

・1.M23

-2.M25

-01^971

-OjOLXS

-J..7474

J-3B45

-2.4W7

-2.5435

-0-P944

□4064

1Q

-2.7S12

■^0243

■1-7523

4.2149

^.9807

0.7751

1.4CW

1.8W55

0.9513

・QL1545

0A473

4,4593

2.9508

4.3866

-5.541S

-M695

22945

-0.8712

0.5583

-04441

0.OT14

3.0451

6.5765

1.B702

--I3B66

-6.29OB

-9.34-17

-3.7231

・5.MB5

-0.1217

43.0363

0.0552

-0.0733

13

12.8614

-4.5062

・7^749

-12.0211

-茁45制

-Z7B0a

-5.1M9

-0.6246

-0.3873

■0-7045

・0.0253

14

-2.45S2

15.&

976

-4.6375

-1O.S725

-135213

-Lfi.ssas

・0398

-5J2602

-L6M1

-1.3S13

-0J311

15

10.3271

-11.9013

-11.1&

46

-iti.sms

-tl.6345

・6.4152

・SJ12i9

-1.2J2S7

-2.0267

16

U352

-174053

-1OA125

-11.3W0

$-1271

-M$S2

-1.8411

-uies

-&

-5LW

17

-JQ..3340

-5^165

氓斑&

-4.3Q11

-5-9523

Q.l'

^3

-(M967

18

2.4616

5,6&

35

-21M23

・7,5277

■16,7619

・10,3492

・7,5B93

・7.431D

■2.WO

-2,9357

・LB342

・02^78

19

2.2896

5.1575

-19.2915

-0871

-13.7525

-6.072^

-54905

-1.5745

-2.0017

-L6322

-0477B

2.1196

&

74S9

-2J292

-11.3W2

-CB214

-4.4066

-2.2193

4J.7396

-L6B07

-0.M14

图9语音样本“语音信号处理”的前20帧的c(5)~c(16)12阶的倒谱参数

MFCC参数

语音信号对应97个MFCC特征参数。

图10显示了语音“语音信号处理”和“为毕业奋斗”的图。

图10语音“语音信号处理”和“为毕业奋斗”的MFCC参数图。

5、分析现今常用模版训练(在说话人识别系统中此步骤叫做说话人码本的训练)方法,选取适合本课题的说话人码本训练方法。

目前针对各种特征而提出的说话人识别方法主要有以下几类:

(1)动态时间规整方法:

说话人信息不仅有稳定因素(发声器官的结构和发声习惯),而且有时变因素(语速、语调、重音和韵律)。

DTW将识别模板与参考模板进行时间对比,按照某种距离测度得出两模板间的

相似程度。

(2)矢量量化方法:

把每个人的特定文本训练成码本,识别时将此码本对测试文本进行量化,以量化产生的失真度作为判决标准。

禾U用矢量量化的说话人识别方法的判断速度快,而且识别精度也不低。

(3)马尔可夫模型方法:

它是一种基于转移概率和输出概率的随机模型,它把语音看成由可观察到的

符号序列组成的随机过程,符号序列则是发声系统状态序列的输出。

在使用隐马尔可夫模型识别时,为每个说话人建立发声模型,通过训练得到状态转移概率矩阵和符号输出概率矩阵。

识别时计算未知语音在状态转移过程中的最大概率,根据最大概率对应的模型进行判决。

对于与文本无关的说话人识别一般采用各态历经型HMM;

对于与文本有关的说话人识别一般采用从左到右型HMM。

(4)人工神经网络方法:

它在某种程度上模拟了生物的感知特性,是一种分布式并行处理结构的网络模型,具有自组织和自学习能力、很强的复杂分类边界区分能力以及对不完全信息的鲁棒性,其性能近似理想的分类器。

但神经网络方法在说话人数目很大时常会出现训练时间长或无法收敛等问题。

(5)支持向量机法:

它是在统计学习理论的基础上发展起来的一种新的机器学习方法。

统计学习理论建立在一套坚实的理论基础之上,它为解决有限样本学习问题提供了一个统一框架,并将很多现有方法纳入

其中,有望帮助解决许多原来难以解决的问题(比如神经网络结构选择、局部极小点和过学习等问题)。

SVM

已初步表现出很多优于已有方法的性能,在解决有限样本、非线性及高维模式识别问题中表现出许多特有

的性能。

而且SVM在说话人识别中也获得了比较广泛的应用,效果较好。

SVM试图用最优分类器划分样

本空间,使得不同子类空间中的样本到分类器的距离达到最大,而对于在当前特征空间中线性不可分的模式,SVM使用核函数把样本映射到高维空间中,使得样本能够线性可分。

但该方法仅限于小样本的分析,而且核函数的选择至今也没有完善的理论可依。

基于此,本文选取快速简单的矢量量化法,并对其进行相应的优化已达到满意的识别效果。

矢量量化

方法中,模糊C-均值聚类算法常用来训练说话人的码本。

下面介绍模糊C-均值聚类的具体理论

5.1模糊C-均值聚类

1973年,Bezdek提出了模糊C-均值聚类算法。

FCM把N个数据矢量分成M个模糊组,并求出每组的聚类中心,与普通硬聚类算法相比,FCM利用隶属度函数确定每个矢量属于各个分组的程度,如此更能描述数

据的中介属性,客观的反映了现实。

定义FCM的目标函数为:

NM

blur2

JFCM(X,U,Y)=^2;

u「r(Xi)d(Xi,Yk)

i£

k土

其中X={X1,X2,…,Xn}URS为待分类的数据矢量组,Xi为其中的第i个矢量。

Y={丫!

丫2,…,Ym}为聚类

中心集,Yk表示第k个聚类中心YoU={ui,U2,...,Um}为FCM隶属度函数集,blur=[1,"

为模糊度,Uk(Xi)

为数据矢量Xi对第k个聚类中心Yk的隶属度函数,满足0Wu«

Xi)<

1(Euk(Xi)=1,k=1,2,…,M),d(Xi,

Yk)2为Xi和Yk之间距离的平方。

实际上,聚类就是通过隶属度函数Uk和聚类中心Yk的不断更新,寻找

目标函数最小值的过程。

寻找目标函数Jfcm的最小值时,Uk和Yk的迭代公式为:

N

送ublur(xjx

Yk=,1兰k^M

乞ublur(Xi)

i=1

-2T

ukXi=

d(X”Yk疋

M2

瓦d(Xi,Yj严

存在的问题

(1)但FCM聚类算法存在着对初始值敏感,收敛结果易陷入局部极小值的问题,严重影响了聚类效果,阻碍了识别系统性能的提升。

(2)码本训练过程中如何降低或者消除噪声的影响。

(3)如何选取最优的系统评价指标。

三、论文的主要创新点

(1)研究加权美尔倒谱参数在说话人识别系统中的运用。

(2)研究了一种粗聚类与FCM聚类相结合的说话人识别方法。

该方法利用基于欧式距离的粗聚类算法对说

话人的特征矢量集进行聚类,参考粗聚类输出的结果设定FCM聚类算法的聚类数目和初始聚类中心坐标,

然后再利用FCM聚类算法聚类原特征矢量集形成说话人的码本,以此来克服传统模糊C-均值(fuzzy

c-means,FCM)聚类算法对初始值敏感、收敛结果易陷入局部极小的问题。

四、论文的后期工作安排:

(包括:

内容、时间及工作量估计)

(1)7~9月,研究改进模糊c-均值聚类的方法,并完成说话人识别系统的设计。

(2)9~10月,进行说话人识别实验记录相关数据,完成大论文的主要工作。

(3)10~12月,完成大论文的撰写和修改工作,准备毕业答辩。

五、参考文献

1NakhatFatima,Thomas,FangZheng.ShortUtteraneeSpeakerRecognition[C].InternationalConferenceonSystemsandInformatics(ICSAI),2012,Page(s):

1746~1750.

2XingYuJuan,LiHengjie,TanPin.HierarchicalFuzzySpeakerIdentificationBasedOnFCMandFSVM[C].InternationalConferenceonFuzzySystemsandKnowledgeDiscovery,2012,Page(s):

311~315.

3FuhengQu,YatingHu,YongYang,etc.AConvergeneeTheoremforImprovedKernelBasedFuzzyC-MeansClusteringAlgorithm[C].InternationalWorkshoponIntelligentSystemsandApplications(ISA),2011Page(s):

1~4.

4LinZhu,Fu-LaiChung,ShitongWang.GeneralizedFuzzyC-MeansClusteringAlg

- 配套讲稿:

如PPT文件的首页显示word图标,表示该PPT已包含配套word讲稿。双击word图标可打开word文档。

- 特殊限制:

部分文档作品中含有的国旗、国徽等图片,仅作为作品整体效果示例展示,禁止商用。设计者仅对作品中独创性部分享有著作权。

- 关 键 词:

- 语音 识别 论文 中期 报告

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

《雷雨》中的蘩漪人物形象分析 1.docx

《雷雨》中的蘩漪人物形象分析 1.docx