南开大学20春学期(1709、1803、1809、1903、1909、2003)《网络爬虫与信息提取》在线作业答案45600Word格式.docx

南开大学20春学期(1709、1803、1809、1903、1909、2003)《网络爬虫与信息提取》在线作业答案45600Word格式.docx

- 文档编号:13073286

- 上传时间:2022-10-04

- 格式:DOCX

- 页数:6

- 大小:12.67KB

南开大学20春学期(1709、1803、1809、1903、1909、2003)《网络爬虫与信息提取》在线作业答案45600Word格式.docx

《南开大学20春学期(1709、1803、1809、1903、1909、2003)《网络爬虫与信息提取》在线作业答案45600Word格式.docx》由会员分享,可在线阅读,更多相关《南开大学20春学期(1709、1803、1809、1903、1909、2003)《网络爬虫与信息提取》在线作业答案45600Word格式.docx(6页珍藏版)》请在冰豆网上搜索。

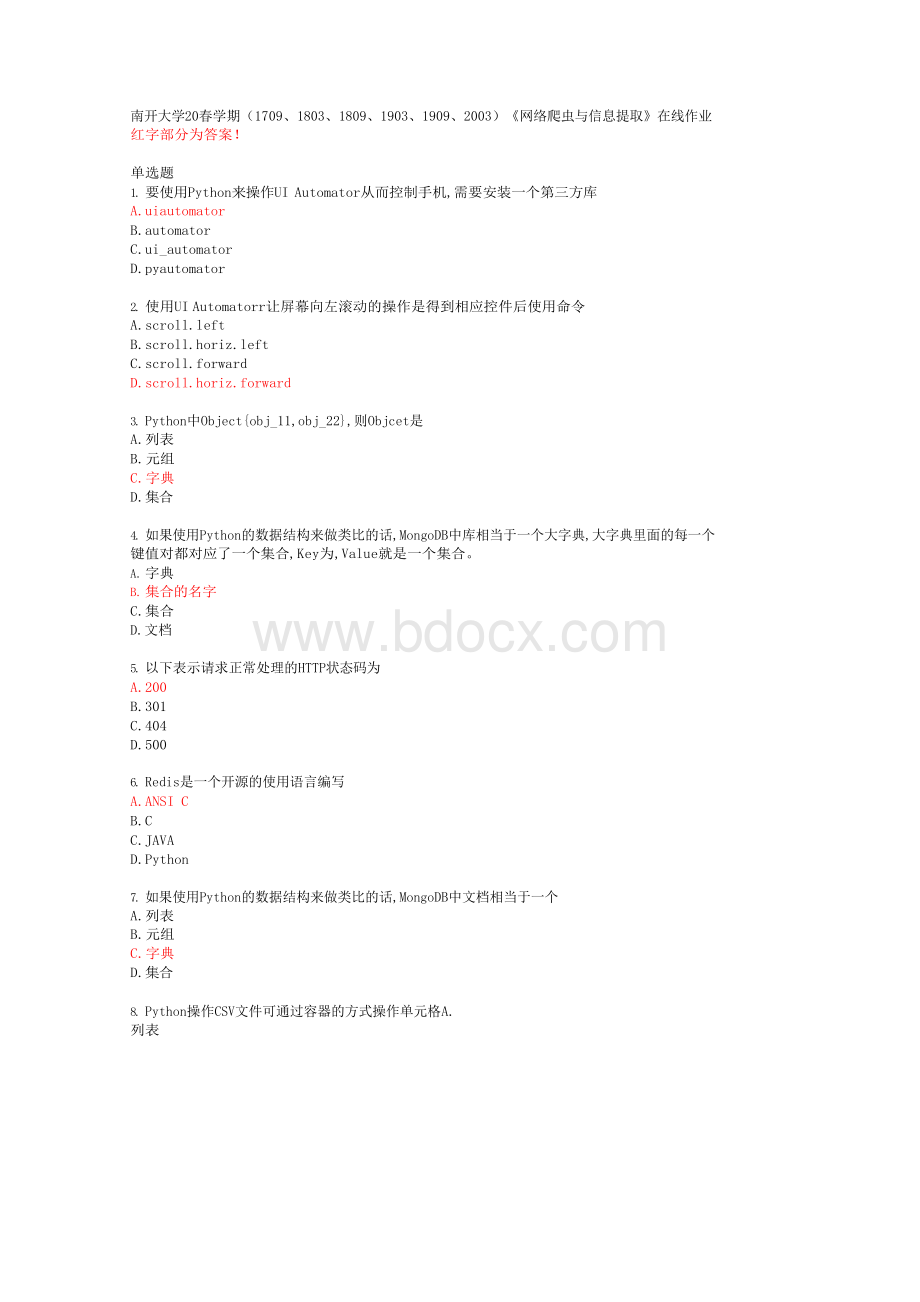

A.字典

B.集合的名字C.集合

D.文档

5.以下表示请求正常处理的HTTP状态码为A.200

B.301C.404D.500

6.Redis是一个开源的使用语言编写A.ANSIC

B.CC.JAVA

D.Python

7.如果使用Python的数据结构来做类比的话,MongoDB中文档相当于一个A.列表

8.Python操作CSV文件可通过容器的方式操作单元格A.列表

9.PyMongo中逻辑查询表示大于的符号是A.gt

B.ltC.gtelte

10.Python正则表达式模块的findall方法返回结果为A.列表

11.Python中Object{obj_11,obj_22},则Objcet.getboj_3,3是A.1

B.2C.3

D.无输出

12.Python正则表达式模块的findall方法提取内容包含多个,则返回结果的列表中会包含A.列表

13.在Scrapy的目录下,哪个文件负责数据抓取以后的处理工作A.spiders文件夹

B.item.pyC.pipeline.pyD.settings.py

14.如果计算机上连接了很多台手机,查看这些手机串号,需要在终端输入以下命令A.adbdevice

B.adbdevicesC.adbdevices-l

D.adbdevices-list

15.下列哪项不是HTTP的请求类型A.GET

B.POSTC.PUTD.SET

16.MongoDB中数据存储的形式类似于A.列表

B.元组C.字典

D.集合

17.以下表示请求资源找不到的HTTP状态码为A.200

18.用Xpathh获取第二个div标签应该是A.dvi1

B.div2C.div[1]

D.div[2]

19.使用UIAutomator使屏幕向上滚动一屏的操作是得到相应控件后使用命令A.scroll_forwad

B.scroll_upC.scroll.forwardD.scroll.vert.forward

20.chrome默认打开开发者工具的快捷是A.F5

B.F11C.F12D.F2

多选题

1.针对解析源代码的BeautifulSoup对象,构造时BeautifulSoup网页源代码,解析器中的解析器可以为

A.htmlB.html.parserC.lxml

D.xml

2.HTTP常用状态码表明表明服务器本身发生错误的有A.403

B.404C.500D.503

3.MongoDB中获取名字为set1的集合的语句为A.database.set1

B.databaseset1C.database[set1]D.database{set1}

4.Python中通过Key来从字典object中读取对应的Value的方法有A.object[key]

B.object.getkey

C.object.popkeyD.object.pop

5.自动填充验证码的方式有A.手动识别填写

B.图像识别C.打码网站

D.浏览器自动识别

6.Python中与元组由类似的数据读取方式A.字符串

B.列表C.字典D.集合

7.HTTP常用状态码表明表明客户端是发生错误的原因所在的有A.403

8.使用Selennium获取网页中元素的方法有A.find_element_by_nameB.find_element_by_idC.find_elements_by_nameD.find_elements_by_id

9.使用BeautifulSoup对象后可以使用来查找内容A.find_all

B.findC.searchD.search_all

10.Python中的容器有A.列表

判断题

1.默认情况下,MongoDB可以通过外网访问A.正确

B.错误

2.下载器中间件里面的报错一般是由于外部原因引起的A.正确

3.使用UIAutomatorr让屏幕向右滚动的操作是得到相应控件后使用命令scroll.horiz.forward

A.正确B.错误

4.使用Scrapyd,可以实现一键部署Scrapy爬虫,访问一个网址就启动/停止爬虫A.正确

B.错误

5.操作文本难以实现自动化,而操作图形界面可以容易的实现自动化。

A.正确

6.开源库pytesseract的作用是将图像中文字转换为文本。

7.MongoDBURI的格式为mongodb//服务器IP或域名端口用户名密码

A.正确B.错误

8.Python中使用下面代码打开文件也需要对文件进行close关闭操作withopen文件路径,文件操作方式,encodingutf-8asf

9.如果通过爬虫抓取某公司网站的公开数据,分析以后发现这个公司业绩非常好,于是买入该公司股票并赚了一笔钱。

这是合法的。

10.在Linux的终端使用apt-get命令安装一系列依赖库时,其中如果存在有已经安装的库,会覆盖掉之前的库重新安装

11.Robo3T与RoboMongo是完全不一样的软件A.正确

12.使用UIAutomator使屏幕向上滚动一屏的操作是得到相应控件后使用命令scroll.vert.forwardA.正确

13.把cookies这段文本放在Redis里面,可以使scrapy请求网页时始终保持登录状态A.正确

14.middlewares.py是下载器中间件A.正确

15.Selenium必须加载对应的webdriver才能模拟浏览器访问A.正确

16.数字越大的中间件越先被执行A.正确

17.包含或超过50万人的个人信息,或者包含国家关键信息的数据,如果要转移到境外,必须经过主管或者监管部门组织安全评估。

18.打码平台都是靠机器使用OCR技术识别图片上的文字。

19.charles配置中,安装完成证书以后,在设置中打开“关于本机”,找到最下面的“证书信任设置”,并在里面启动对Charles证书的完全信任。

A.正确

20.数据抓包就是中间人爬虫的一个简单应用。

所以使用Charles也是一种中间人攻击A.正确

- 配套讲稿:

如PPT文件的首页显示word图标,表示该PPT已包含配套word讲稿。双击word图标可打开word文档。

- 特殊限制:

部分文档作品中含有的国旗、国徽等图片,仅作为作品整体效果示例展示,禁止商用。设计者仅对作品中独创性部分享有著作权。

- 关 键 词:

- 网络爬虫与信息提取 南开大学 20 学期 1709 1803 1809 1903 1909 2003 网络 爬虫 信息 提取 在线 作业 答案 45600

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

链接地址:https://www.bdocx.com/doc/13073286.html

第二章-传统相机的性能与种类.ppt

第二章-传统相机的性能与种类.ppt

三级健康管理师题库(附答案).docx

三级健康管理师题库(附答案).docx

专业分包合同风险控制要点一览表 - 副本.rtf

专业分包合同风险控制要点一览表 - 副本.rtf